エッジAIの「現実解」 分散型の推論システムとエージェントが描く次世代AI活用:オンプレでの生成AI基盤導入がトレンドに

生成AIへの注目度が高まる一方で、ストレージやネットワーキングへの投資の増加など、コストやリソースの増加は、生成AI活用の定着を阻む壁にもなっている。そうした中、デル・テクノロジーズが提唱するのが、分散して配置した複数のAIエージェントを連携させてマルチモーダルのデータを処理する、次世代AI活用の姿だ。

生成AI活用のために乗り越えなくてはならない課題

昨今、業界業種や規模の違いを問わずあらゆる企業の間で生成AIが注目されているが、当然のことながらこの技術にも「強み」と「課題」がある。

まずは強みだが、比較対象として従来の識別型AIを例にとって考えてみよう。識別型AIは画像認識など特定のタスクでは高い成果を上げるものの、対象物が変わると途端に精度は低下する。クルマの自動運転技術などに識別型AIを応用しようとする試みもあるが、常に新しいデータを学習し続ける必要があり、周辺環境が絶えず変化する道路・交通状況に対応するのは極めて困難である。

デル・テクノロジーズ インフラストラクチャー・ソリューションズSE統括本部AIプラットフォーム ソリューションズでシニアシステムエンジニア AI Specialist / CTO Ambassadorを務める増月孝信氏は、アイティメディア主催のオンラインイベント「エッジAIイニシアチブ 2025」で講演した際、「そうした識別型AIに対して、生成AIは『汎用化』と『コンテキスト認識能力』の大きく2つの強みを持っており、新しいデータについても柔軟に認識し、推測することができます」と語った。

一方で生成AIの課題となるのは、その精度が確率論的に決まることだ。結果として生成AIは、もっともらしいうそ(ハルシネーション)を自信満々で出力することがある。

「したがって現状では、生成AIが出力した答に対する最終的な判断は人間に委ねられることになります」(増月氏)

さらに生成AIの処理に膨大なリソースが必要とされる点も、各企業での定着化に向けての高いハードルとなる。

一般的に生成AIサービスでは、10バイト程度のトークンと呼ばれる最小単位で処理量をカウントして課金されるが、プロンプトとして入力したテキストは、大規模言語モデル(LLM)の埋め込み処理によって高次元のベクトル表現に拡張されると、トークンの容量は数10キロバイトまで一気に膨張する。そしてマルチモーダルの世界になると、トークンの容量はさらに飛躍的に増大していくことになる。

加えてRAGによる埋め込みコンテンツの大規模なライブラリを保存するストレージや、ネットワーキングに対する投資も膨らんでいく。「こうして肥大化するコストの問題から逃れることができません」(増月氏)

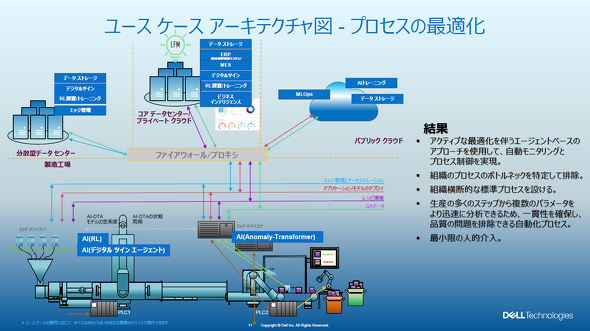

分散エージェント型マルチモーダルLLMが製造業にプロセスにもたらす効果

上記のような生成AIの課題を解決すべくデル・テクノロジーズが提唱しているのが「分散エージェント型マルチモーダル LLM」である。

単一の巨大なLLMにすべての推論を任せるのではなく、既存の識別型AIと複数の専門的なAIエージェントが連携しつつ、マルチモーダルのデータ(テキスト、画像、音声、動画など)を処理し、複雑なタスクを遂行する次世代AIの概念だ。

また、複数のAIエージェントやLLMを複数のサーバやエッジデバイス、さらには個人PCなどクライアントデバイスに分散して配置することで、処理能力の向上、スケーラビリティの確保、分散による消費電力要件の軽減、データプライバシー保護などが可能になる。

これにより物理的なITリソースの制限や時間的な制約を受けていたユースケース、あるいは識別型AIと生成AIの“良いとこ取り”をした、より汎用的なユースケースへの対応が実現することになる。

「設計データやコーディングデータ、顧客データ、工場内の生産データなど、機密性の高いデータをRAGで生かしつつ、企業内での生成AI活用を加速させていくためにも、分散エージェント型マルチモーダルLLMの構築が求められます。現状の生成AI活用はパブリッククラウドが中心ですが、コストやセキュリティ、ネットワークのレイテンシといった観点からも、オンプレミス環境やエッジデバイス上への生成AIシステム導入のトレンドが近い将来に到来すると考えています」(増月氏)

実際に分散エージェント型マルチモーダルLLMは、工場での生産活動をはじめ製品開発や品質保証、ロジスティクス(製品の出荷)まで含めた下記のような効果にもとづき、製造業のプロセス全体の最適化に大きく貢献すると考えられる。

- アクティブな最適化を伴うエージェントベースのアプローチを使用して、自動モニタリングとプロセス制御を実現

- 組織のプロセスのボトルネックを特定して排除

- 組織横断的な標準プロセスの策定

- 生産の多くのステップから複数のパラメータを迅速に分析した一貫性の確保

- 品質問題を排除する自動化プロセスの導入

- 人的介入の最小化

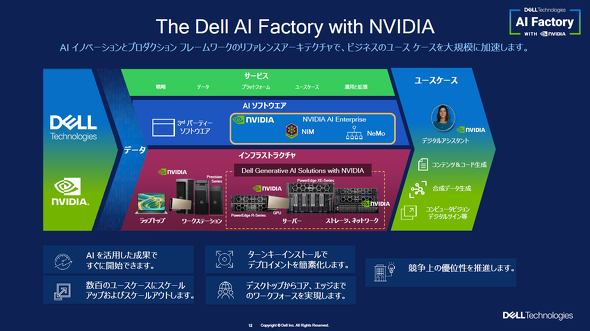

AIイノベーションを加速する「Dell AI Factory with NVIDIA」

分散エージェント型マルチモーダルLLMを構築する基盤となるのが、「Dell AI Factory with NVIDIA」である。デル・テクノロジーズとNVIDIAが共同開発した包括的なAIソリューションで、AIモデルの開発・学習から運用、管理まで、AIのライフサイクル全体を効率化、自動化するための統合インフラとサービスを提供する。

「AIイノベーションならびにプロダクションフレームワークのリファレンスアーキテクチャとして、ターンキーインストールでAIエージェントやLLMのデプロイメントを簡素化し、エッジからデスクトップ、データセンター、クラウドに至るワークフォースを実現します。これにより生成AIによる成果をすぐにビジネスで活用できます。さらにデジタルアシスタント、コンテンツ&コード生成、合成データ生成、コンピュータビジョン、デジタルツインなど、複数のユースケースに加速的にスケールアップおよびスケールアウトを図ることで、市場における競争優位性を確立していきます」(増月氏)

なお、分散エージェント型マルチモーダルLLMは、インフラストラクチャ、AIソフトウェア、サービスの大きく3つの階層のソリューションで構成されている。

このうちデル・テクノロジーズが中心的な役割を担っているのはインフラストラクチャのレイヤーで、NVIDIA製GPUを搭載したサーバをはじめストレージやネットワークなど、「Dell AI Solution with NVIDIA」と呼ばれる事前検証済みの生成AI構成ステックで統合されたハードウェアプラットフォームを提供している。

その一環として、ことし(2025年)5月に米国ラスベガスで開催されたグローバル年次イベント「Dell Technologies World 2025」で発表されたのが、「Dell PowerEdge XE9780/9785サーバー」と「Dell PowerEdge XE9780L/9785Lサーバー」だ。

「いずれもAIモデルのトレーニングとファインチューニングのために専用設計されたサーバです。NVIDIA Blackwell Ultra GPUと高速ネットワークを統合した『NVIDIA HGX B300』を最大8基搭載可能で、LLMの学習を従来の4倍の速度で実行します。特にDell PowerEdge XE9780L/85Lは最新の水冷サーバと冷却ラックを採用することで冷却コストを最大60%削減し、より高密度の生成AI環境を実現します」(増月氏)

ほかにもサーバの新ラインアップとして、NVIDIA RTX Pro 6000 Blackwell Server Edition PCIe GPUを最大8基搭載可能で、高速のAIアクセラレーションによりアプリケーションの柔軟性を向上する「Dell PowerEdge XE7745サーバー」の発売も予定している。

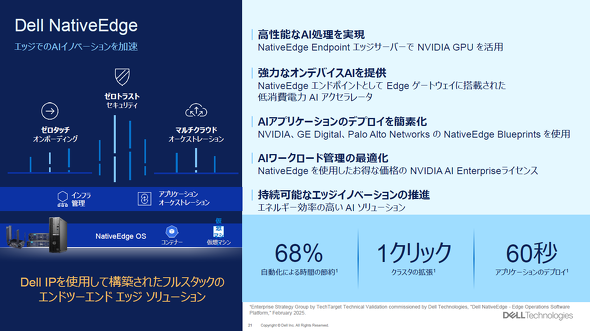

一方、エッジ側でのAIイノベーションを加速すべく提供しているのが、「Dell NativeEdge」というエッジAI基盤向けのソフトウェアプラットフォームだ。

「デバイスの電源を入れてネットワークに接続するだけで自動的に設定が完了する『ゼロタッチオンボーディング』、信頼できるエッジデバイスのみにアクセスを制限する『ゼロトラストセキュリティ』、複数のクラウドやオンプレミスに分散したエッジデバイスを中央から一元管理する『マルチクラウドオーケストレーション』といった特徴を備えた、エンドツーエンドのエッジソリューションです」(増月氏)

まずは「Dell AI Factory」で最新AIテクノロジーを体感

ここまで述べてきたとおり、分散エージェント型マルチモーダルLLMの導入はすでに現実解となっており、海外の多くの企業はPoC(Proof of Concept:概念実証)のフェーズを迎えている。

「具体的なPoCの事例として、製造業ではファクトリーデータサイエンスへのAI活用、デジタルツイン/デジタルスレッドの構築、IT/OTの融合、災害からの回復やサイバーリカバリー、産業サイバーセキュリティの強化、品質管理およびマシンビジョンの向上、プライベートモビリティ/5G(第5世代移動通信)接続、レガシーシステムとのワークロード統合などを目的とした、多様な取り組みが見られます。さらにリテールやヘルスケア(遠隔医療など)といった業界でもPoCが活性化するほか、スマートシティの分野でも分散エージェント型マルチモーダルLLMの活用が模索されています」(増月氏)

ところが国内に目を向けると、各企業の取り組みは大きく遅れていると言わざるを得ないのが実態だ。分断された縦割りの組織やサイロ化したシステムなどが障壁となり、PoCにも踏み出せていない。

したがって、まずは分散エージェント型マルチモーダルLLMに関する最新テクノロジーやトレンドを体感することが重要だ。デル・テクノロジーズが2024年9月に大手町本社に開設した「AI Innovation Lab」は、その最適な場となる。

具体的にはAI Innovation Labは、次の3つの柱を通じてAIの課題解決に向けたソリューションを提供している。

1つ目は、実証(Lab / Showcase)。世界中のユースケースを産業別に集め、目的に応じた事例の紹介、実証実験、デモを行っている。さらに生成AIやマルチクラウド環境を活用したPoCを実施する。

2つ目は、共創(オープンエコシステム)。オンプレでの生成AI導入をサポートするLLM ISVを含めたAIエコシステムパートナーと共創し、企業ごとに最適なソリューションスタックを作り、効果的かつ効率的なイノベーションの実現を目指す。

3つ目は、学び(デル・テクノロジーズアカデミー)。ITの基礎からAI技術、データサイエンスなど、AI人材のキャリア形成に必要なスキル・知識の習得を支援する。

「AI Innovation Labは開設してからまだ1年弱ですが、すでに2000人近くの国内企業の皆様にご来場をいただきました。業種ごとのワークショップも実施していますので、奮ってお申込みください」と増月氏は広く呼び掛けており、ぜひこの機会を生かして本格的なAI活用への一歩を踏み出すことをおすすめしたい。

Copyright © ITmedia, Inc. All Rights Reserved.

関連リンク

提供:デル・テクノロジーズ株式会社

アイティメディア営業企画/制作:EE Times Japan 編集部/掲載内容有効期限:2025年9月1日