「GPT-4」を上回る性能で、グラフィカルな文書を読解するLLM技術:NTTの「tsuzumi」にも採用

NTTは2024年4月12日、大規模言語モデル(LLM)の活用により、文書に含まれる図表やグラフなども含めて理解し、自然言語での指示に従って読解/応答する「視覚読解技術」を実現したと発表した。

NTTは2024年4月12日、大規模言語モデル(LLM)の活用により、文書に含まれる図表やグラフなども含めて理解し、自然言語での指示に従って読解/応答する「視覚読解技術」を実現したと発表した。今後、カスタマーサポート業務の補助や自然言語指示による作業の自動化など、オフィスDX(デジタルトランスフォーメーション)の推進への貢献が期待できる。

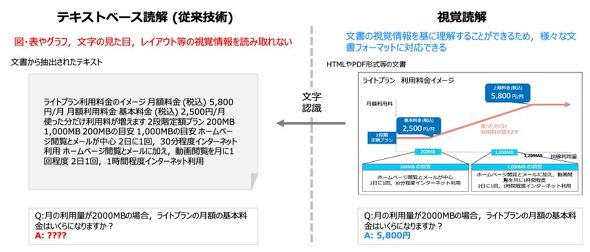

視覚読解技術とは、実世界の文書を視覚的に(画像として)理解し読解する技術だ。今日では、図表やグラフ、文字の見た目、レイアウトなどの視覚情報を用いた文書が多く扱われているが、従来のテキストベースの読解技術では、それらの視覚情報を読み取ることが難しかった。また、従来の視覚読解技術では、請求書に関する情報抽出のタスクなど、任意の文書やタスクに対応することが難しいため、目的のタスクや文書ごとに一定数のサンプルを用意して学習を行う必要があった。

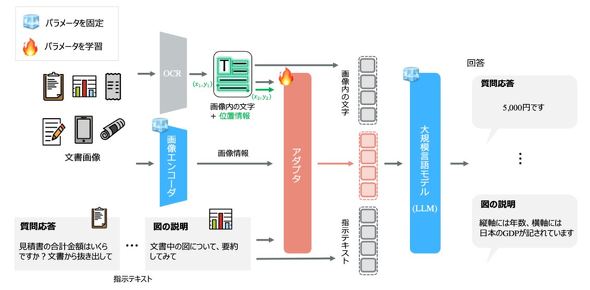

そこでNTTは、「文書画像を画像情報に変換する画像エンコーダー」と「画像情報を読解するLLM」をつなぐアダプター技術を開発した。モデルパラメータの大部分を占めるLLMや画像エンコーダーのパラメータを固定にし、アダプターのみを学習対象にすることで、パラメータ効率の良い学習を実現したという。

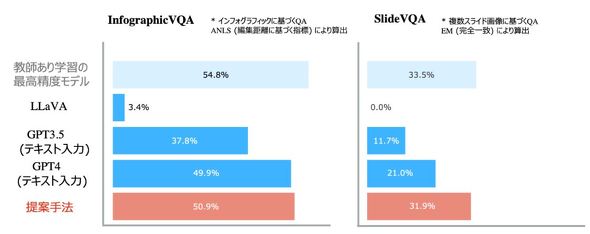

また、同社は、さまざまな視覚文書読解タスクを対象とした指示遂行用のデータセットを構築した。文書画像を知識源とし、質問応答や情報抽出、文書分類をはじめとする12種類の視覚読解タスクを人間の指示を基に遂行できる。これにより、未学習のタスクにおいても、目的タスクで学習を行った教師ありモデルや「GPT-4(テキスト入力のみ)」に匹敵、あるいは上回る性能を実現した。同社担当者は「ユーザー側での追加の学習は不要だ。ただし、特定の情報に対して追加学習を行うことで、読解精度を高めることができる」と説明した。

同社担当者は今後について「作業自動化など、人間と共に価値を生み出すようなAI技術の実現に向けて研究開発を進めて行く」とコメントした。

今回発表した視覚読解技術は、2023年度における東北大学 データ駆動科学・AI教育研究センター 教授の鈴木潤氏との共同研究の成果だ。NTTが2024年3月25日に商用提供を開始したLLM「tsuzumi」のアダプター技術として採用/導入されている他、2024年2月20〜27日にカナダ・バンクーバーで開催されたAI(人工知能)分野の国際会議「The 38th Annual AAAI Conference on Artificial Intelligence(AAAI2024)」にも採択されている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

NTTが大規模言語モデル「tsuzumi」を提供開始、既に500社/団体が興味

NTTが大規模言語モデル「tsuzumi」を提供開始、既に500社/団体が興味

NTTは2024年3月25日、同社が独自開発した大規模言語モデル(LLM)「tsuzumi」の商用提供を開始した。まずはパラメーターサイズが70億のモデルを活用するサービスから提供を開始する。既に約500社/団体から案件ベースでの相談を受けているという。 6G向け「サブテラヘルツ帯無線デバイス」を開発、100Gbpsを実現

6G向け「サブテラヘルツ帯無線デバイス」を開発、100Gbpsを実現

NTTドコモとNTT、NECおよび、富士通は、サブテラヘルツ帯(100GHz帯と300GHz帯)に対応した無線デバイスを共同開発した。この無線デバイスを用いて無線伝送実験を行い、見通し内の伝送距離100mで100Gビット/秒(bps)の超高速伝送を実証した。 日本語精度が高い130億パラメーターのLLMを開発

日本語精度が高い130億パラメーターのLLMを開発

リコーは、日本語の精度が高い130億パラメーターの「大規模言語モデル(LLM)」を開発した。顧客の業種や業務に合わせたカスタムLLMを2024年春より順次、クラウド環境で提供する。 「LLMの巨大化」が生成AIのボトルネックに

「LLMの巨大化」が生成AIのボトルネックに

急成長が予想されている生成AI(人工知能)においてボトルネックとなるのは、LLM(大規模言語モデル)の巨大化、つまりパラメーター数の増加だという。SambaNova Systemsなどが、こうしたボトルネックについて語った。 国産の生成AI/基盤モデルの開発へ、経産省が講演

国産の生成AI/基盤モデルの開発へ、経産省が講演

経済産業省 商務情報政策局 情報産業課 ソフトウェア・情報サービス戦略室 企画官の小川宏高氏は、「EdgeTech+ 2023」のセミナーに登壇し、生成AIを中心に、日本の半導体・デジタル産業戦略について語った。