自動運転でFPGAの期待値高まる、ザイリンクスがデモ:国際カーエレクトロニクス技術展(2/3 ページ)

ザイリンクスは、「第9回 国際カーエレクトロニクス技術展」(2017年1月18〜20日、東京ビッグサイト)で、ディープラーニングを使った歩行者認識、IRカメラによるドライバーモニタリングシステム、Ethernet AVBを使った高速伝送のカメラシステムなど、ADAS(先進運転支援システム)や自動運転向け技術をデモ展示した。

顔と目の位置を正確にトラッキング

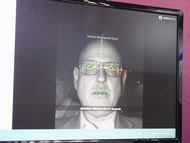

ザイリンクスの顧客企業であるFovioは、Zynq-7020を用いたドライバーモニタリングシステムを展示した。IR(赤外線)ライトとIRカメラを用いて、ドライバーの顔と目の位置をリアルタイムでトラッキングする。IRカメラを用いていることから、サングラスをかけたりマスクを着用したりしていても、顔と目の位置を正しく特定できる。

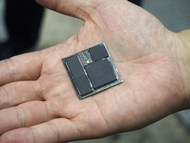

左=デモの様子。手前にあるのが、IRライトとIRカメラを搭載したユニット/中央=目をトラッキングしているところ。上を見ている、目が開いている、といったことを検出できる。実はこの時、写真の人物はサングラスをかけていた。それにもかかわらず、ここまで正確に目をトラッキングできる/右=このシステムに搭載しているZynq-7020。同チップに、画像処理のアルゴリズムを実装している(クリックで拡大)

左=デモの様子。手前にあるのが、IRライトとIRカメラを搭載したユニット/中央=目をトラッキングしているところ。上を見ている、目が開いている、といったことを検出できる。実はこの時、写真の人物はサングラスをかけていた。それにもかかわらず、ここまで正確に目をトラッキングできる/右=このシステムに搭載しているZynq-7020。同チップに、画像処理のアルゴリズムを実装している(クリックで拡大)ドライバーモニタリングシステムは、今後のADASにおいて必須になってくると考えられている。このようなシステムを、ローエンドのZynq-7020を使うことで、コストを抑えて開発できるようになるとザイリンクスは説明する。「目のトラッキングをもう1歩進め、HUD(ヘッドアップディスプレイ)を視線で制御するといったことも可能になるだろう」(ザイリンクス)

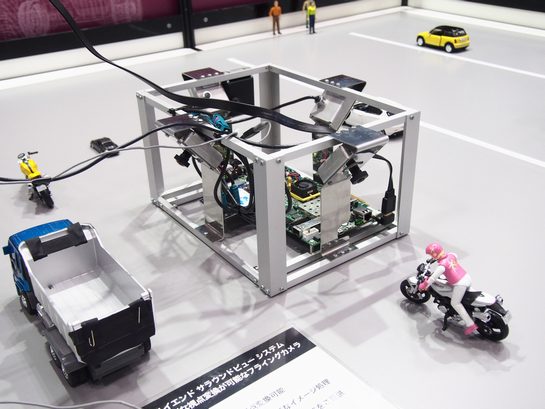

4つのカメラを用いたサラウンドビューシステム

4つのカメラを用いたサラウンドビューシステム(Xylonが提供)も展示した。クルマの前後左右に搭載した4つのカメラで得た画像を、Zynq-7020でリアルタイムに合成し、AR(拡張現実)技術を使って鳥瞰図としてディスプレイに表示する。このような処理は、これまでは大型PCにグラフィックボードを接続したようなシステムがなければ難しかった。それを1個のZynq-7020で実現できるようになっている。

ザイリンクスは「このようなシステムはカーナビゲーションシステムなどでニーズがある。駐車する時にも便利だ。今後は、こうしたサラウンドビューシステム向けのチップは、(28nmプロセスを適用しているZynq-7020から)16nmプロセスのZynq UltraScale+MPSoCに移行していく予定だ。データアナリティクス機能も搭載し、歩行者などを認識できるようにしたい」と説明する。

Copyright © ITmedia, Inc. All Rights Reserved.