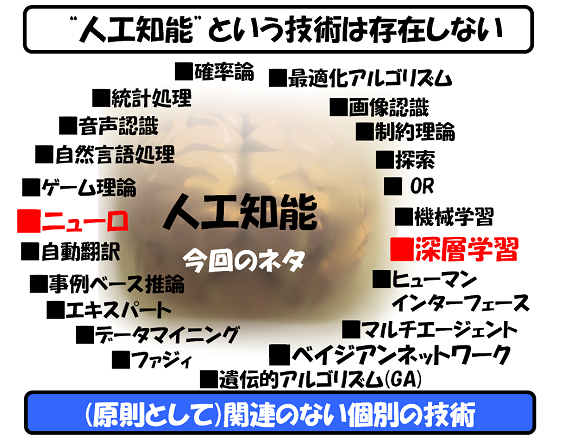

不幸な人工知能 〜尊敬と軽蔑の狭間で揺れるニューラルネットワーク:Over the AI ―― AIの向こう側に(21)(2/9 ページ)

今回のテーマは、第3次AI(人工知能)ブームを支えているといっても過言ではない花形選手、ニューラルネットワークです。ただしこのニューラルネットワーク、幾度もダイナミックな“手のひら返し”をされてきた、かわいそうなAI技術でもあるのです。

実はかわいそう? ニューラルネットワークの歴史

こんにちは、江端智一です。今回と次回の2回を使って、現在進行中の第3次AIブームの最大のけん引技術である「ニューラルネットワーク」と、その学習方法「逆伝搬学習(バックプロパゲーション)」と「深層学習(ディープラーニング)(こっちは、次回に詳解します)」についてお話したいと思います。

また、これまでこの連載では「AI」についての、マスコミ、政府、企業、そして、多くの人々についての、ありとあらゆる批判を行ってきましたが、今回は、最後のターゲットへの批判を行います ―― 私たち、研究員、エンジニアです。

さて、まず本論に入るまえに、ニューラルネットワークの歴史についてお話します。

ニューラルネットワークは、ニューラルネット、ニューロネット、ニューロ(×ニューロン)などとも呼ばれていますが、基本的には、これらの言葉は同じ意味で使われています。今回は、「ニューラルネットワーク」で統一します。

実は、この「ニューラルネットワーク」は不幸な過去を抱えた ―― 尊敬と軽蔑を交互に受けてきた ―― かわいそうなヤツ(技術)なのです。

人類最初のニューラルネットワークの研究は1943年にさかのぼります。この時、人工的なニューロンのモデル化が行われ、その後、ニューロンの学習研究が始まり、1957年に「パーセプトロン」が発表されます。

パーセプトロンは、与えられた教師データが直線で区別できることが可能であれば(これを線形分離といいます)、必ず学習に成功して、線形分離するニューラルネットワークを作ることができるのです(パーセプトロンの収束定理(1962年)) ―― イメージとしては、グランドでウルトラクイズを行う時に、YesとNoの回答者を、100メートルの長さの棒でグループ分けする、という感じです。

ところが、パーセプトロンは、収束が遅く、ノイズに影響されやすく、さらに、線形分離できない学習データには手も足も出ない、という問題がありました。また、多層ネットワークも拡張ができないことが分かり、直線で分離できない学習データ以外では全く使いものにならないことが判明して、急速にパーセプトロンのブームは冷え込んでいきました ―― 1回目の「尊敬」から「軽蔑」への転換です。

ところが、1986年に提唱された「逆伝搬学習方式 ―― プロパゲーション」が、非線形な分離を解決することが分かったとき、世界中で大騒ぎになりました(私も、相当興奮したのを覚えています)。

特に、モデル化されたニューロンの信号発火関数(シグモイド関数)の偏微分が、美しい数式で記述できることを知った時、私は恍惚となったことを覚えています(理解する必要はありません)。

非線形問題が解けるなら、全ての問題は解決できる。人工知能は完成したも同然 ―― と、私ですら、そんなことを信じられる時代があったのです(遠い目)。多分、今の深層学習 ―― ディープラーニングを理解した時よりも、興奮していたと思います。

ところが、実際に私がバックプロパゲーションを実装してみたところ、「ニューラルネットワークが、全然、学習してくれない」ということが分かってきました(後述します)。

(A)学習の成否が初期値で決まる(ローカルミニマム)、(B)逆伝搬が下層に働かない(勾配消失問題)、そして、(C)学習データだけを強く覚えてしまう(過学習問題)ことが、明らかになり、バックプロパゲーションがうまく機能せず、多層ニューラルネットワークが簡単には作れない―― ということが分かるにつれて、2回目の「尊敬」から「軽蔑」への大転換が行われたのです。

Copyright © ITmedia, Inc. All Rights Reserved.