Qualcommがデータセンター向けAI市場に本格参入:推論アクセラレーターを発表(1/2 ページ)

Qualcommはサーバ市場において、急速に競争が激化しつつあるデータセンター向けAI(人工知能)推論処理の分野に参入するという、新たな挑戦を試みている。

Qualcommはサーバ市場において、急速に競争が激化しつつあるデータセンター向けAI(人工知能)推論処理の分野に参入するという、新たな挑戦を試みている。

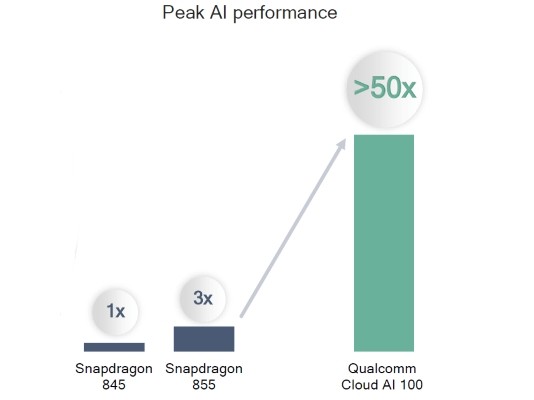

同社は、2019年4月9日(米国時間)に開催されたイベント「AI-DAY」の会場において、「当社は、7nmプロセスを適用したクラウド向けAI推論アクセラレーター『Cloud AI 100』のサンプル出荷を開始する予定だ。電力効率を大幅に高め、350TOPS(Trillion Operations Per Second)を超えるピーク性能を実現することができる。2020年には量産を開始する予定だ」と発表した。

このCloud AI 100に関しては、限られた情報しか明かされていない。しかし、Qualcommでプロダクトマネジメント担当シニアバイスプレジデントを務めるKeith Kressin氏は、「Cloud AI 100の1W当たりの性能は、既存製品と比べて10倍高い」と主張している。

Qualcommの経営幹部たちは、ほとんど詳細を明かさなかったものの、「当社のエンジニアたちのDNAには、スマートフォン向けチップメーカーとして、電力効率の向上実現を目指す精神が深く根付いている」と述べ、Cloud AI 100の電力効率の高さを強調した。

またKressin氏は、「最も電力効率が高いプロセッサを実現するには、まずモバイルに関する考え方から着手する必要がある」と述べる。

活発化している推論アクセラレーター市場

現在、推論アクセラレーター向け市場では、NVIDIAのGPUが最も優勢を確立しているが、Googleの「TPU(Tensor Processing Unit)」やAWS(Amazon Web Service)の「AWS Inferentia」などの、より特化されたソリューションも使われている。AI推論向け専用の半導体チップの開発を手掛けているメーカーは、IntelやXilinxなどの大手メーカーから、GraphcoreやWave Computing、Mythicなどのさまざまな新興企業に至るまで幅広く、合計で30社を超えるという。

米国の市場調査会社The Linley Groupでプレジデント兼主席アナリストを務めるLinley Gwennap氏は、「Qualcommは、優れた性能を実現することによって、他のメーカー各社との差別化を図る必要がある。同社の経営幹部たちは、単に電力効率をアピールしたいようだが、スマートフォン市場とサーバ市場では、実現可能なものの種類が全く異なる」と述べている。

また同氏は、「Qualcommからの情報が不十分なため、Cloud AI 100が今後成功するかどうかを予測することは非常に難しい。Cloud AI 100の量産開始は、2020年後半以降となる見込みのようだが、AI推論市場は急速に進化しているため、その頃には、状況が現在と全く異なっている可能性がある」と付け加えた。

米国の市場調査会社であるMoor Insights & Strategyでプレジデント兼主席アナリストを務めるPatrick Moorhead氏は、「Cloud AI 100は今回、とても良いスタートを切ることができ、将来が有望視されている。約2〜5Wの最大出力を目標としたことで、Qualcommのターゲット市場と、NVIDIAのハイエンドGPU『Tesla T4』を推論向けに使用している高性能サーバ市場とを区別することができている」と述べている。

Copyright © ITmedia, Inc. All Rights Reserved.