Arm MLプロセッサ、明らかになったその中身:モバイル機器でのエッジAI向け(5/5 ページ)

2018年8月に開催された「Hot Chips 30」では、Armの「ML Processor(MLプロセッサ)」の中身が明らかになった。その詳細を解説する。

モバイル機器でのEdge AIに向けたソリューション

Armによる説明はおおむねこんなところだが、少し説明を補足しておきたいと思う。

冒頭にも書いたが、Arm MLプロセッサのメインターゲットは現時点ではMobile SoCである。要するにスマートフォンやタブレット上でのEdge AIに向けたソリューションである。Edge AIといえば、つい最近もLeap Mindのこんな記事(「エッジAIを安価・高速に、FPGAを駆使するベンチャー」)があって、こちらはこちらですごく正しいのだが、実際にはArmのMLプロセッサとはまず競合しない(というか、し得ない)。

理由は簡単で、FPGAがスマートフォンの中に入らない(というか、入れない)からだ。もちろん、PMICとかI/Fなどに向けて、それこそLattice Semiconductorの「ICE40」クラスの物が搭載されることは珍しくないが、これはあくまでもGlue Logic向けであって、Programmableなソリューションとしては利用できない。

もし将来、Mobile向けSoCに内蔵される形でFPGA Fabricが搭載されれば、そこではLeap Mindのソリューションが生きてくるだろうが、そこまではそれこそQualcommやHiSilicon、そして今回のArm MLのような専用アクセラレータが幅を利かせ続けるだろう。Leap Mindのソリューションは、スマートフォン以外のEdge Deviceを当面は主戦場とすることになり、将来Arm MLプロセッサのIPがスマートフォン以外をターゲットにした時にぶつかるという形になると思われる。

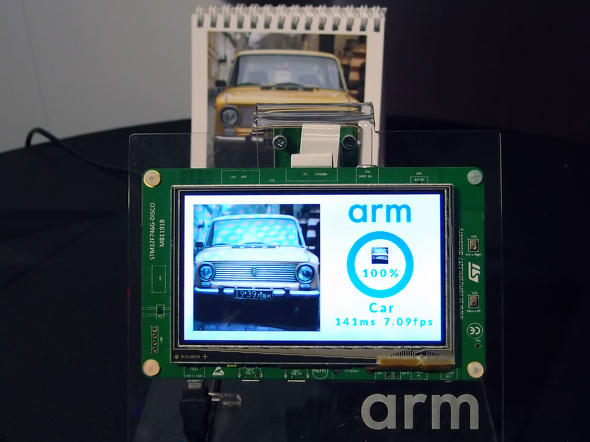

もっとも、そうした時期はそう遠くないかもしれない。写真1は2018年6月の「COMPUTEX TAIPEI」におけるArmの発表会会場で展示されていた例だが、Cortex-M7のDSPを利用してArmNNを動かし、ここの上で画像認識を行っている例である。

やっていることは簡単で、撮影しているものが自動車か否かを判定しているだけだが、この程度の用途(例えば自動販売機の前に人間が立ったら照明をOnにするとか)で良ければ既存のDSPベースでもなんとかなる。ここに例えば1〜2 Compute Engineを搭載したArm MLプロセッサが統合されていれば、消費電力を落としつつ更に高いスループットで認識が可能になるだろう。MLプロセッサ統合MCU vs MCU+FPGAという戦いは、意外にすぐ始まりそうな気もする。

それはともかく。今回のArm MLプロセッサでやはり肝になるのはコンパイラということになるだろう。特に図20に出てきたTilingにあたるような、うまく作業を分散させてDRAMへのアクセスを最小に抑えるような仕組みは、どっちかといえば動かしてProfileを取って、それを基に調整を掛けて……という作業が必須(というか、これ無しでStatic Analysisだけでどこまで最適化ができるのかが疑問)である。

コンパイラの中でシミュレーションまで可能だったりするのか、それともArm MLプロセッサ側にProfileを取る仕組みも用意されているのか、現状では情報が一切ない。情報がないと言えば、Programmable Layer Engineの中のVector Processorに何ができるのか、ということも、現状不明なままである。ただし図2にあるように、2018年中にはこのArm MLプロセッサの提供を予定しているので、それに合わせて細かな開発者向け情報が出てきてくれるはずである。2018年10月に米国シリコンバレーで開催される「Arm TechCon 2018」では、この辺りの詳細が明かされることを期待したいものだ。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ArmのAI戦略、見え始めたシナリオ

ArmのAI戦略、見え始めたシナリオ

機械学習についてなかなか動きを見せなかったArmだが、モバイルやエッジデバイスで機械学習を利用する機運が高まっているという背景を受け、少しずつ戦略のシナリオを見せ始めている。 Armの独壇場にはならない? AI向けコア市場

Armの独壇場にはならない? AI向けコア市場

CPUコアにおいて、多くの分野で高いシェアを誇るArmだが、AI(人工知能)エンジン向けチップのコアでは、独壇場とはいかないようだ。 NVIDIAが解説するディープラーニングの基礎(前編)

NVIDIAが解説するディープラーニングの基礎(前編)

エヌビディアは2018年4月24日、ディープラーニングに関するセミナー「NVIDIA Deep Learning Seminar 2018」を東京都内で開催した。本稿では、セッション「これから始める人のためのディープラーニング基礎講座」から、ディープラーニングの歴史や概要、学習の流れについて紹介する。 Armの独壇場にはならない? AI向けコア市場

Armの独壇場にはならない? AI向けコア市場

CPUコアにおいて、多くの分野で高いシェアを誇るArmだが、AI(人工知能)エンジン向けチップのコアでは、独壇場とはいかないようだ。 Arm、クライアント向けCPUのロードマップを発表

Arm、クライアント向けCPUのロードマップを発表

Armは、モバイル端末機器やラップトップコンピュータなどクライアント向けCPUのロードマップとパフォーマンス数値を発表した。 求む、「スーパーメモリ」

求む、「スーパーメモリ」

ARM Researchの講演内容を紹介してきたシリーズ。完結編となる今回は、ARMが「スーパーメモリ」と呼ぶ“理想的なメモリ”の仕様を紹介したい。現時点で、このスーパーメモリに最も近いメモリは、どれなのだろうか。