AlphaICs、深層学習向けコプロセッサをサンプル出荷:8TOPSのエッジAI推論性能を実現

スマートビジョンアプリケーション向けエッジAI(人工知能)および学習チップの開発を手掛けるスタートアップAlphaICsは、深層学習向けコプロセッサ「Gluon」のサンプル出荷を開始した。Gluonには、ソフトウェア開発キット(SDK)も付属する。

スマートビジョンアプリケーション向けエッジAI(人工知能)および学習チップの開発を手掛けるスタートアップAlphaICsは、深層学習向けコプロセッサ「Gluon」のサンプル出荷を開始した。Gluonには、ソフトウェア開発キット(SDK)も付属する。

高いfps/ワット性能を実現

Gluonコプロセッサは、TSMCの16nm FinFETプロセスを適用し、8TOPSのエッジAI推論性能を実現するという。AlphaICsが発表した数値によると、ニューラルネットワークで1秒あたりに分類および検出できるフレーム数(fps)/ワット(W)性能は、「Yolo-V2」オブジェクト検出モデルで32fps/W、「VGG-19」分類モデルで22fps/Wだという。

Gluonは、監視や産業、小売、自動車、産業用IoT(IIoT)などのアプリケーションにおけるスマートビジョンの分類と検出、セグメンテーションのための深層学習ニューラルネットワークモデルの高速化に特化している。

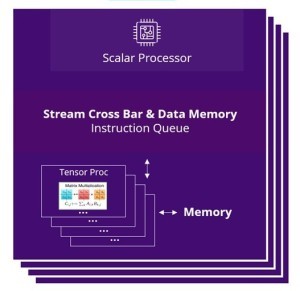

Gluonチップは、モジュール式でスケーラブルな独自のアーキテクチャを使用する、AlphaICのRAPアーキテクチャをベースとしている。同チップのフレームワークには複数の”エージェント”が含まれており、それぞれにスカラプロセッサと複数のTensorプロセッサ、専用のオンチップSRAMメモリが搭載されている。スカラプロセッサで基本演算(フェッチ、決定、実行、インタフェース)を実行した後、Tensorプロセッサを使用してAI計算を実行する。エージェントおよびTensorプロセッサの数を増減させることでスケーラビリティを実現する。

Gluonは、AlphaICsが開発を予定している初のチップファミリーで、16個のRAPエージェントと16個のTensorプロセッサの16×16構成となっている。

また、GluonはPCIeとLPDDR4インタフェースを組み込むことで、ホストプロセッサとDRAMそれぞれへの高速転送を実現している。同チップのベンチマークは以下のようになっている。

- Yolo-V2(画像サイズ416×416×3)で153fps、4.73W

- VGG-19(224×224×3)で79fps、3.6W

Gluonにはニューラルネットワークを展開するためのSDKが付属しており、開発者は現行のX86/ArmベースのシステムにAI機能を追加できる。AlphaICsは、Gluonプロセッサ上でトレーニングしたモデルの展開を可能にするコンパイルおよびランタイムエンジンなど、Gluonプロセッサに関連するソフトウェアスタックを開発。初期バージョンは「TensorFlow」フレームワークをサポートしており、他のフレームワークもサポートするためにスタックを拡張する計画だという。

AlphaICsのCEO(最高経営責任者)を務めるPradeep Vajram氏によると、同社は現在、顧客向けにGluon技術のデモを行っているという。同氏は、「当社のチームは過去2年間、この素晴らしいマイルストーンの達成に懸命に取り組んできた」と述べている。対象となるAIビジョンアプリケーションは、監視や小売、産業、スマートシティーなどだ。

同社はまた、ビデオ監視製品を専門とする日本のCBCとチャンネルパートナーシップを構築している。CBCはAlphaICsと2年近く協力関係にあり、日本でのマーケティングパートナーを務める。

【翻訳:滝本麻貴、編集:EE Times Japan】

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

米BrainChipがSNNプロセッサ向け開発キットを発表

米BrainChipがSNNプロセッサ向け開発キットを発表

ニューロモーフィックコンピューティングIP(Intellectual Property)のベンダーである米BrainChipは、2021年10月に米国カリフォルニア州サンタクララで開催され 「Linley Fall Processor Conference」で、同社のニューロモーフィックプロセッサSoC(System on Chip)「Akida」の開発キットを発表した。 性能と演算量を調整可能なスケーラブルAI技術

性能と演算量を調整可能なスケーラブルAI技術

東芝と理化学研究所(理研)は、学習済みAIの性能をできる限り落とさずに、演算量を調整できる「スケーラブルAI技術」を開発した。プロセッサの処理能力が異なる応用システムの場合でも、AIエンジンの共有化が可能となる。 NVIDIA「DRIVE Atlan」、1000TOPSの信ぴょう性

NVIDIA「DRIVE Atlan」、1000TOPSの信ぴょう性

現在、自動運転車の市場は潜在的な可能性を秘めている。NVIDIAのCEOであるJensen Huang氏は、「数兆米ドル規模のエコシステム」の実現に向けた計画を自社イベント「GTC(Graphic Technology Conference)」でアピールした。 AIチップ新興企業に成熟の兆し

AIチップ新興企業に成熟の兆し

ここ数年の間、AI(人工知能)チップ新興企業の“カンブリア爆発”(一気に出現すること)について書かれた記事が多くみられるようになった。初期に登場した一部の企業は、自社のAIチップを搭載したモジュール/カードなどを広く提供することによって、実世界においてデザインウィンを獲得したり、世界的な流通チャネルを構築するなど、成熟しつつあるようだ。 AIチップ市場、2026年まで成長率40%で伸びる

AIチップ市場、2026年まで成長率40%で伸びる

AIチップセット市場が、約40%の年平均成長率で成長を遂げている。大量の複雑なデータセットの存在や、顧客企業が性急に推進してきた商用アプリケーションの増加、深層学習やニューラルネットワークの幅広い普及などが後押しとなったのではないかと見られている。 スタートアップがひしめくAIチップ市場の現状

スタートアップがひしめくAIチップ市場の現状

AI(人工知能)チップ市場は現在、“深層学習が全て”という状態にある。深層学習は、実世界の中でAIアプリケーションを役立てるという機械学習の枠組みの中で、最も成功している分野である。