AIは“人の脳への回帰”でさらに進化する?:高性能で超省エネ(2/2 ページ)

AI(人工知能)をさらに発展させるヒントは、人間の脳にあるかもしれない。「ISSCC 2018」で、フランスCEA-Letiに聞いた。

人間の脳は超省エネ

同氏は、「人間の脳の処理能力は、20Wにおいて1011GOPSだ。現在のところ、人間の脳に匹敵する性能と消費電力を実現することが可能なプロセッサは、世界中のどこにもない。

人間の体は、長い年月をかけた進化の中で、脳の機能を最大化しながらエネルギーの使用量を最小限に抑えることにより、このような高いレベルの効率性を実現してきたのだ」と説明する。

「半導体業界は、生物学からヒントを得ることができるのではないか。既存のコンピューティングアーキテクチャは、プロセッサとメモリの間でデータ伝送を行うたびに電力を消費しなければならないため、消費電力要件をいかに満たすか、悪戦苦闘しているところだ。その一方で脳シナプスは、1つのアーキテクチャ上に、メモリとコンピューティングを統合している。このような巧妙な方法から、脳にヒントを得た非ノイマン型(von Neumann)コンピュータアーキテクチャの実現に向け、基礎を構築することができるのではないだろうか」(同氏)

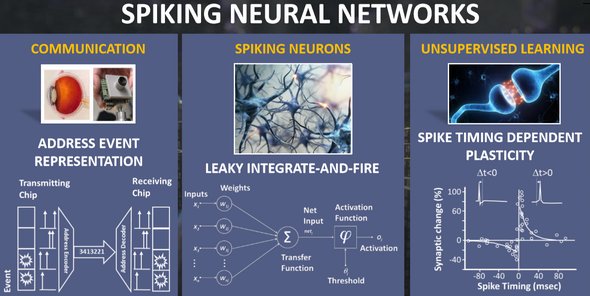

脳にヒントを得た動作原理に関しては、スパイクコーディングやスパイクタイミング依存シナプス可塑性(STDP:Spike-Timing Dependent Plasticity)などの要素が不可欠である。De Salvo氏は、「ニューロンの状態は、システム上でどのようにエンコードされるのか。ニューロン値はこれまで、アナログ量あるいはデジタル値を使用してエンコードされてきた。だが神経形態学的コンピューティング分野の最近の傾向としては、ニューロン値をパルスまたはスパイクとしてエンコードするようだ。ニューロンは、クロックではなくイベントで駆動する」と述べる。

科学コミュニティーは、スパイクコーディングとSTDPを有望視しているようだ。入力および出力信号がパルス(スパイク)として表示されるのであれば、入力信号とシナプス荷重を乗算することで、シナプスレベルでゲート操作することになる。これにより消費電力を低減することを目指しているという。

De Salvo氏は、「神経形態学的CMOS集積回路の好例として挙げられるのが、IBMの『TrueNorth』だ。また、現在28nm FD-SOIプロセスが適用されているDynapSEL(Dynamic Neuromorphic Asynchronous Processor Scalable-Learning)も、大規模なマルチコア神経形態学的プロセッサの一例だといえる。DynapSELは、欧州の共同研究プロジェクト『NeuRAM 3』において、開発が進められているところだ」と述べる。

TrueNorthは、ニューロンをデジタル処理しているが、DynapSELはアナログ処理だ。しかしいずれも、神経形態学的システムの全出力を活用できているわけではない。メモリが、神経形態学的原理をベースとしたものではないからだ。

科学コミュニティーは現在、既存のメモリに変革をもたらし、“インメモリコンピューティング”の実装を実現すべく、メモリをプロセッサユニットの近くに配置するための取り組みを進めている。De Salvo氏は、「これまでにデモが披露されている神経形態学的ハードウェアは、その能力をまだ最大限に発揮できていない。ニューロンとシナプス間のコネクティビティおよびコンフィギュラビリティを最大化するためには、神経形態学的コンピューティングにおける超高密度3Dアーキテクチャの実現が不可欠だ」と述べる。

「現在、人間の脳には1000億個のニューロンが存在することが分かっている。ミツバチのような高度な知的能力を持つ昆虫の場合、脳の体積1mm3当たりのニューロン数は、95万個に達する。ミツバチの脳は、昆虫の中でも最も大きい。現在既に、ミツバチの脳の中でこれらのニューロンがどのようにマッピングされているのかが解明されている。だが、人間の脳のニューロンについては、ほとんど解明されていない」(De Salvo氏)

【翻訳:田中留美、編集:EE Times Japan】

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

細胞の“ゆらぎ”を利用すれば超省エネマシンができる!? ――CiNetの研究開発

細胞の“ゆらぎ”を利用すれば超省エネマシンができる!? ――CiNetの研究開発

生体が超省エネで活動できる理由は、細胞の“ゆらぎ”にあるという。ゆらぎを応用すれば、非常に低い消費電力で稼働するシステムを実現できるかもしれない。脳情報通信融合研究センター(CiNet)の柳田敏雄氏が、「NICTオープンハウス2014」の特別講演で語った。 “生体コンピュータ”の実現へ、米大学がCMOSを組み込んだ有機体の生成に挑む

“生体コンピュータ”の実現へ、米大学がCMOSを組み込んだ有機体の生成に挑む

米国のジョージア工科大学の研究チームが、超低消費電力の“生体コンピュータ”の実現に取り組んでいる。研究チームは、まずはCMOSセンサーと細胞を組み合わせて、創薬や医療診断の分野に生かしたいとしている。 東芝、深層学習を低消費電力で実現する半導体回路

東芝、深層学習を低消費電力で実現する半導体回路

東芝は2016年11月、ディープラーニング(深層学習)の処理を低い消費電力で実行する“人間の脳を模した”半導体回路「TDNN(Time Domain Neural Network)」を開発したと発表した。 AIの“苦悩”――どこまで人間の脳に近づけるのか

AIの“苦悩”――どこまで人間の脳に近づけるのか

人工知能(AI)の研究が始まった1950年代から、AI研究の目的は「人間の大脳における活動をいかにコンピュータ上で実現させるか」だ。大手IT企業や大学の努力によって、AIは少しずつ人間の脳に近づいているのは確かだろう。一方で、自然言語処理の分野では、“人間らしさ”を全面に押し出した「人工無能(人工無脳)」も登場している。 未来を占う人工知能 〜人類が生み出した至宝の測定ツール

未来を占う人工知能 〜人類が生み出した至宝の測定ツール

今回は、統計処理技術についてお話します。え? 統計? それってAIなの?――そう思われた読者の方、確かにAI技術とは言えません。ですが、統計処理技術はAIの根底を成すものであり、これを知らないままでは、「英単語を知らずに英語を話そうとする」ようなものなのです。 力任せの人工知能 〜 パソコンの中に作る、私だけの「ワンダーランド」

力任せの人工知能 〜 パソコンの中に作る、私だけの「ワンダーランド」

私はこれまで、人口問題や電力問題、人身事故などさまざまな社会問題を理解するためにシミュレーションを利用してきました。シミュレーションは、AI(人工知能)という概念を飛び越えて、「人間が創造した神」と呼べるかもしれません。今回は、シミュレーションに最適なAI道具の1つとして、「オブジェクト指向プログラミング」を解説します。これは、PCの中に“私だけのワンダーランド”を力任せに作る技術ともいえます。