数時間で実装できるエッジAI 推論性能は「Jetson」に比べて10倍:米新興のSiMa.ai(2/2 ページ)

エッジAI用ソリューションを手掛ける米新興のSiMa.ai(シーマドットエーアイ)が、日本市場への展開を本格化している。消費電力が同等の場合、CNN(畳み込みニューラルネットワーク)の推論性能を10倍に高速化できることが特徴だ。

コンパイル済みモデルを用意、わずか数時間で実装可能に

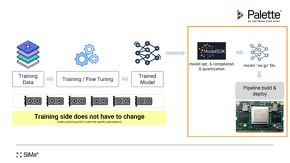

SiMaがハードウェア同様に力を入れているのがSDK(ソフトウェア開発キット)だ。同社は「Palette」というSDKを用意している。これを使うと、学習済みモデルを量子化/最適化してコンパイルするところから、SiMaのチップに実装するまでの工程を簡単に実行できる。エッジAIでは、FP32(32ビット浮動小数点)で表現された学習済みモデルを8ビットに量子化し、モデルを最適化してコンパイルしてデバイスに実装するのが一般的なフローだが、「ここがとにかく手間がかかる」と林田氏は説明する。「SDKが整っていないと、組み込みエンジニアが自分たちで開発せざるを得なくなる。モデルの量子化からチップ実装までが、最も簡素化したい工程だったので、われわれもかなり時間をかけてPaletteを開発してきた」

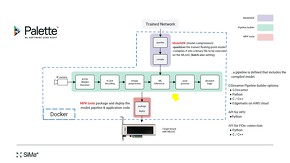

「Palette」のイメージ。Paletteをインストールすると、右側の図に青い点線で示す部分がDockerのように全てPCにインストールされる。C++やPythonでも記述できるようになっている[クリックで拡大] 出所:SiMa

「Palette」のイメージ。Paletteをインストールすると、右側の図に青い点線で示す部分がDockerのように全てPCにインストールされる。C++やPythonでも記述できるようになっている[クリックで拡大] 出所:SiMaさらに、SiMaはコンパイル済みのモデルを同社のWebサイトにアップロードしている(参考)。推論性能(fps)と精度から、どのようなモデルがあるのかをマッピングしている表もあり、モデル名とともにINT8で量子化したときの精度、SiMaのチップに実装したときの推論精度なども記載されている。

開発者は、これらのモデルをダウンロードしてチップに実装するだけでLlavaのようなモデルをすぐに動かせる。「当社が提供している評価キットに電源を入れ、Paletteをインストールし、それに沿って進めれば、数時間後には代表的なモデルを動かすことができる」と林田氏は強調する。

日本でも多数の評価が進行中

SiMaのソリューションは、自律走行搬送ロボット(AMR)や先進運転支援システム(ADAS)、AIアシスタント機能など、既にさまざまな分野で採用事例や評価中の事例がある。

日本では、マクニカと新光商事が販売代理店を務めている。「1年前に日本法人を設立したばかりでまだまだ活動できていないが、日本では多数の評価が並行して進んでいる。ロボットメーカーからも高い関心を得ている。日本でも対象マーケットの裾野は広いと考えている」(林田氏)

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

「フラッシュメモリで」AI演算 消費電力はGPU比で1000分の1に

「フラッシュメモリで」AI演算 消費電力はGPU比で1000分の1に

フローディア(Floadia)が、SONOS構造のフラッシュメモリを用いて超低消費電力で推論を行うCiM(Computing in Memory)技術を開発中だ。GPUに比べ1000分の1ほどの消費電力で積和演算を実行できるという。2025年春ごろには試作チップができ上がる。 エッジAIにこそ先進パッケージング技術が必要

エッジAIにこそ先進パッケージング技術が必要

クラウドAI向けでよく語られる3次元実装だが、UCMの担当者は先進パッケージングはエッジAIにこそ向いていると語る。 NVIDIAやCerebrasをはるかに上回るトークン性能、欧州新興のAIチップ

NVIDIAやCerebrasをはるかに上回るトークン性能、欧州新興のAIチップ

欧州のAIチップの新興企業であるEuclydは、トークン当たりのコストを低く抑えられるハードウェアアーキテクチャを披露した。同社のチップ「Craftwerk」は、16384個のSIMDプロセッサを搭載し、最大8PFLOPS(FP16)または32PFLOPS(FP4)を実現する。NVIDIAやCerebras Systemsをはるかに上回る、2万トークン/秒を実行できるとする。 デバイスを「超省エネ」に導く IPOで製品展開を加速するAmbiq

デバイスを「超省エネ」に導く IPOで製品展開を加速するAmbiq

エッジAI用半導体を手掛ける米Ambiq。半導体を低消費電力で動作できる独自技術「SPOT(スポット)」を生かし、いずれはデータセンターへの展開を目指す。 ReRAM CiM、メモリ大容量化と10年記憶を両立

ReRAM CiM、メモリ大容量化と10年記憶を両立

東京大学の研究グループは、ヌヴォトンテクノロジージャパンと共同で、低電力エッジAI半導体である「ReRAM CiM」について、多値記憶によるメモリの大容量化を実現しつつ、10年間にわたる高い信頼性を両立させた。

![ユースケースの例[クリックで拡大] 出所:SiMa](https://image.itmedia.co.jp/ee/articles/2512/15/mm251211_sima08.jpg)