IoT時代、ディープラーニングの主用途は制御か:PFN、同社のAI事業を説明(2/2 ページ)

Preferred Networks(PFN)は、IoT(モノのインターネット)にディープラーニングを活用する意義について、自社の応用例を挙げて説明した。また、IoTの普及でデータ量がどの程度増加するかを取り上げた上で、ディープラーニングの処理性能向上に向けた自社の取り組みについて語った。

データ量1.6ZB時代に必要な処理性能

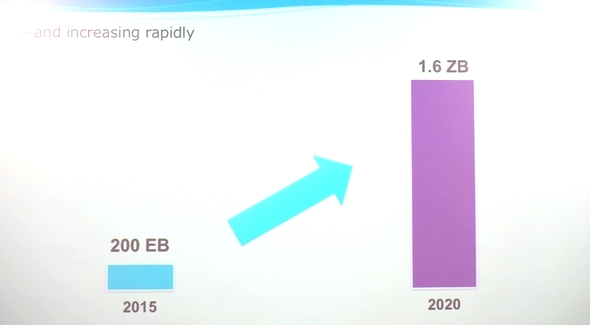

PFNはディープラーニングのIoTへの応用だけでなく、IoTの加速により大量のデータが溢れ返る時代に向け、ディープラーニングの処理能力向上にも取り組んでいる。西川氏によると、2015年に200エクサバイト(EB)程度だったデータ量が、2020年にはその8倍の1.6ゼタバイト(ZB)くらいになるという。そうなると、相応の処理性能がディープラーニングに求められる。

副社長の岡野原大輔氏は、「IoTが普及し機械が生成するデータ量が増加すると、ディープラーニングに必要な計算リソースも加速度的に上昇していく。現時点では、数ぺタFLOPS程度(GPU300個分)で済んでいるが、2019年くらいには1エクサFLOPS相当の計算リソースが必要となる。その後、10エクサFLOPS、100エクサFLOPSと、必要な計算リソースは膨れ上がっていく」と説明する。

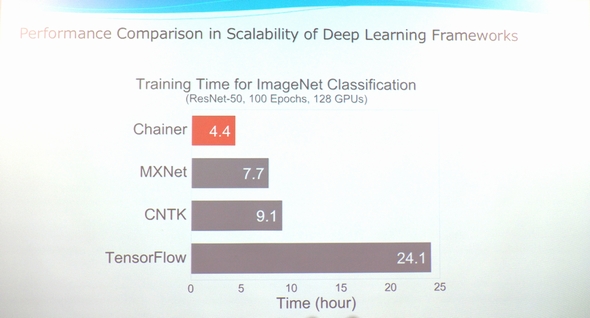

ディープラーニングは学習データが多いほど高精度になるため、いかに大量のデータを学習させるかが重要だ。その手段の1つとして、PFNはスーパーコンピューティング(並列計算)の活用に注目している。同社は既に、ResNet-50というタスクを128個のGPUで並列処理する実験に成功。従来の100倍に近い速度で達成した。

実験では、複数のコンピュータで分散学習する機能を同社のディープラーニングフレームワーク「Chainer」に搭載させるための追加パッケージ「Chainer MN(Multi Node)」を活用した。PFNの齋藤俊太氏によると、MXNet、CNTK、TensorFlowといった他のディープラーニングフレームワークに比べ、Cainer MNは学習完了に必要な時間が短いという。

PFNが注目するもう1つの手段が、同社がエッジヘビーコンピューティングと呼ぶ分散コンピューティングだ。全てのデータをクラウドで一元処理するのではなく、デバイスに近いエッジの部分で分散的にデータを処理する手法である。西川氏は「データ量が爆発的に増加すると、デバイスに近いところ、エッジで処理する必要がある。そうすれば、重要なデータだけをクラウドに上げられるし、全てのデータを対象にできる」と語った。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

ファナックなど、製造業IoT進める情報基盤を発表

ファナックなど、製造業IoT進める情報基盤を発表

ファナックなど4社は、製造業の現場において、さまざまセンサーから得られたデータを1つのプラットフォームで解析することで、設備効率/生産性/品質を向上させることを目的とした情報基盤プラットフォーム「FANUC Intelligent Edge Link and Drive system」を発表した。 ディープラーニングの発展はGPUが加速させる?

ディープラーニングの発展はGPUが加速させる?

NVIDIAは、産業用機器に向けたディープラーニング(深層学習)技術の開発において、Preferred Networksと技術提携をすると発表した。自社の高性能な演算処理能力を持つGPUを用いることで、ディープラーニングの可能性を最大限に広げていくとしている。 スパイラル学習法でドローンを自動操縦

スパイラル学習法でドローンを自動操縦

Preferred Networksは、「CEATEC JAPAN 2016」(シーテック ジャパン、会期:2016年10月4〜7日、会場:千葉市幕張メッセ)で新たな深層強化学習手法を用いて実現したドローンの自動操縦システムのデモを公開する。 JEITAベンチャー賞、第1回は8社が受賞

JEITAベンチャー賞、第1回は8社が受賞

電子情報技術産業協会(JEITA)は、第1回「JEITAベンチャー賞」の授賞企業8社を発表した。CPS(サイバーフィジカルシステム)/IoT(モノのインターネット)の社会実装を推進するJEITAは、優良なベンチャー企業を支援し、関連企業との連携強化を推進していくことで産業発展を後押しする。 人の“模倣”ではないAIで、未来を作る

人の“模倣”ではないAIで、未来を作る

NTTは、「R&Dフォーラム 2016」の一般公開を前に、主な展示をプレス向けに紹介した。AI(人工知能)を搭載した“ぶつからないクルマ”や、眼球の動きから“好みのタイプ”を判別する技術、VR(仮想現実)を利用したスポーツトレーニングのデモなどが披露された。 ディープラーニングの学習で「世界最高速度」実現

ディープラーニングの学習で「世界最高速度」実現

富士通研究所は2016年8月9日、スーパーコンピュータのソフトウェア並列化技術を応用し、複数のGPUを用いてディープラーニングの学習速度を高速化するソフトウェア技術を開発したと発表した。