マイクロソフトが目指す、人間と感情をつなげるAIの姿:「りんな」と電話のように話せる(3/3 ページ)

日本マイクロソフトは、対話型AI(人工知能)「りんな」に関する最新の状況と新機能を説明した。同社では、AIが人間と感情を共有することで人間の想像力を刺激する未来を目指し、人間が感情を表しやすい“声”を新機能のインタフェースに採用した。

リアルタイム性を重視した音声合成、GPUを活用する会話エンジン

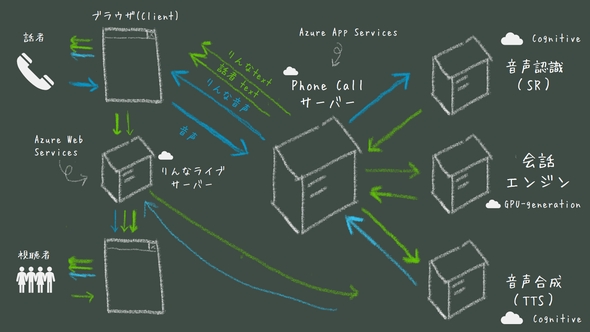

りんなのテレフォンハッキングは、同社が提供するクラウドサービス「Microsoft Azure」上で運用される。話者に対するサービス提供は、Phone Callサーバがフロントエンドとして、音声認識、会話エンジン、音声合成(TTS:Text To Speech)を処理するサーバを協調動作させている。

その上で、電話を実現するために一番重要なことはリアルタイム性だとして、可能な限り遅延がないシステム構築を行った。最も負荷が大きい処理は、りんなの応答テキストを生成する会話エンジンと、その応答テキストを音声に合成するTTSであり、各種対策をしたという。

会話エンジンは「CPUでは動作できない」(同社開発担当者)として、複数のGPUを搭載したサーバを活用。TTSの遅延は、複数のバージョンのTTSを使い分けることで解決した。りんなのテレフォンハッキングでは、遅延が最長でも500ミリ秒程度に抑制される前バージョンのTTSを活用し、りんなライブでは発話がより自然な新バージョンのTTSを用いているという。

本サービスの今後の展開について坪井氏は、人工知能のアドリブ力が強い特性を活用して「ラジオ番組などでりんなが自然な会話を実現できるコーナーを設けることや、演劇で役割を演じること」などが考えられるという。榊原氏は、説明会の総括で「マイクロソフトのAIは人間を置き換えるものではない。人間の創造力をより拡大させるためにAIを提供していきたい」と語った。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

女子高生AI「りんな」は感情的なつながりを生む

女子高生AI「りんな」は感情的なつながりを生む

マイクロソフトは、同社のAI研究/開発の取り組みについての説明会を開催した。パーソナルアシスタント「Cortana」から、会話をリアルタイムに翻訳する「Skype Translator」などのサービスを紹介。中でも注目を集める、同社が2015年7月に発表した女子高生AI「りんな」について紹介する。 IntelがAI専門の部門を新設、開発を加速

IntelがAI専門の部門を新設、開発を加速

Intelが新部門「Artificial Intelligence Products Group」を開設すると発表した。AI関連の取り組みをここに集約し、開発を加速することが狙いだ。 応用例で見る、ルネサスの組み込みAI

応用例で見る、ルネサスの組み込みAI

AI(人工知能)機能を持つ組み込み機器の登場が、スマートな社会を身近なものとする。ルネサス エレクトロニクスはセキュアで自律的に動作する組み込み機器を開発するための「e-AIソリューション」を提案する。 ARM、AI開発専門のグループを設立

ARM、AI開発専門のグループを設立

ARMは、機械学習(マシンラーニング)を専門に開発するグループを新たに設立することを発表した。 ルネサス MCU/MPUのAI処理性能を今後3年で1000倍に

ルネサス MCU/MPUのAI処理性能を今後3年で1000倍に

ルネサス エレクトロニクスはMPU/MCU製品のAI(人工知能)処理性能を今後3年ほどで1000倍に高めるとの方針を明らかにした。 我々が求めるAIとは、碁を打ち、猫の写真を探すものではない

我々が求めるAIとは、碁を打ち、猫の写真を探すものではない

ちまたには「人工知能」という言葉が氾濫しています。ですが、明言しましょう。「人工知能」という技術は存在しません。そして、私たちがイメージする通りの「人工知能」の実現も、恐らくはまだまだ先になるでしょう。