リコー、GBDTモデル学習回路アーキテクチャ開発:GBDTモデル学習を26倍高速化

リコーは、機械学習で注目される「GBDT(Gradient Boosting Decision Tree:勾配ブースティング決定木)」モデルを、高速かつ低消費電力で学習できる回路アーキテクチャを開発した。

モデル学習の電力効率はCPU/GPUに比べ90倍

リコーは2018年12月、機械学習で注目される「GBDT(Gradient Boosting Decision Tree:勾配ブースティング決定木)」モデルを、高速かつ低消費電力で学習できる回路アーキテクチャを開発したと発表した。

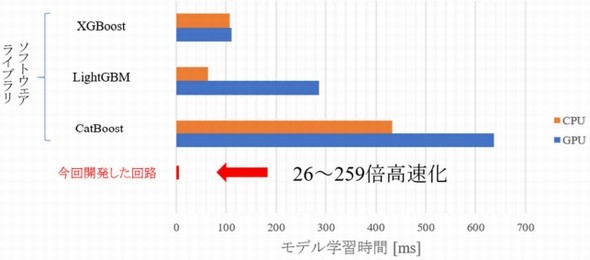

同社は、開発した回路アーキテクチャをFPGA上に実装して、性能を検証した。この結果、CPU/GPUを用いた一般的なソフトウェアライブラリー(XGBoost、LightGBM、CatBoost)と比べ、モデル学習の処理は26〜259倍と極めて速く、GBDTモデルの学習を短い時間で実行可能なことが分かった。

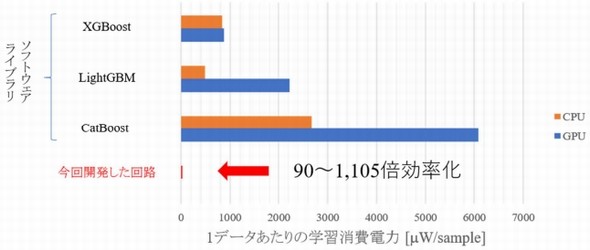

開発した回路アーキテクチャは学習時の消費電力も少なく、モデル学習の電力効率はCPU/GPU利用時に比べ90〜1105倍を達成したという。なお、学習したモデルの予測精度は、ソフトウェアライブラリーで学習したモデルと同等であることを確認している。

GBDTモデルは、データベースなどで構造化された大量データの学習に適しているという。応用分野としてはオンライン広告のリアルタイムビディング、Eコマースでのリコメンデーション、コンピュータによる株式の高頻度取引、サイバー攻撃の検出、ロボティクスなどを想定している。また、高い電力効率という特長を生かし、さまざまなエッジデバイスへの応用も期待される。

なお、同社研究開発本部リコーICT研究所の研究グループは、詳細な研究成果について米国コーネル大学が運営する論文投稿サイトで発表した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

正データと正信頼度の情報だけで分類境界を学習

正データと正信頼度の情報だけで分類境界を学習

理化学研究所(理研)の研究チームは、人工知能(AI)を用いた機械学習の分類問題で、正のデータとその信頼度(正信頼度)情報だけで、分類境界を学習できる手法を開発した。 機械学習を5倍に高速化、FP32と同等精度を9ビットで

機械学習を5倍に高速化、FP32と同等精度を9ビットで

産業技術総合研究所は2018年5月29日、東京大学と共同で、機械学習の学習処理に必要な演算量を削減する計算方式と演算回路を考案したと発表した。今回提案した計算方式では、同研究グループが考案した9ビットの数値表現を用いていることがポイントで、単位消費電力あたりの処理能力が従来方式と比較して約5倍まで向上するという。 AIと機械学習、多くの企業でストレージ支出が増加へ

AIと機械学習、多くの企業でストレージ支出が増加へ

IDC Japanは、人工知能(AI)と機械学習(ML)がストレージ支出に与える影響をユーザー調査した。この結果、国内企業611社のうち、70%が「大きな影響を与える」と認識していることが分かった。 AIの開発、半導体業界にとってますます重要に

AIの開発、半導体業界にとってますます重要に

どの半導体メーカーが、何らかの形でAI(人工知能)分野に携わっているのかは、簡単にリストアップすることができる。ほぼ全てのメーカーが該当するからだ。機械学習(マシンラーニング)は、幅広い可能性を秘めているため、ほとんどの半導体チップメーカーが研究に取り組んでいる状況にある。 深層学習を32ビットマイコンで実現 STがデモ

深層学習を32ビットマイコンで実現 STがデモ

STMicroelectronicsは、「embedded world 2018」で、32ビットマイコン「STM32」にDNN(ディープニューラルネットワーク)を実装するデモを披露した。 NVIDIAが解説するディープラーニングの基礎(前編)

NVIDIAが解説するディープラーニングの基礎(前編)

エヌビディアは2018年4月24日、ディープラーニングに関するセミナー「NVIDIA Deep Learning Seminar 2018」を東京都内で開催した。本稿では、セッション「これから始める人のためのディープラーニング基礎講座」から、ディープラーニングの歴史や概要、学習の流れについて紹介する。