ADASの新たな課題は「センサーのクリーニング」:避けられないコスト増(2/2 ページ)

自動車に、運転支援や自動運転向けに複数の種類のセンサーが搭載されるようになったことで、『予期せぬ事態』が生じている。

Teslaの「レーダー廃止」が注目される理由

複数の異なるセンサーデータが相互に補完し合うことで、単一のセンサーモードよりも優れたADASや自立走行の性能が得られるというのが、複数のセンサーを組み合わせて車両に搭載する一般的な理由である。

しかし、異なる種類のセンサーを追加することが重要な理由は他にもある。ある種類のセンサーの性能が、雨や泥、そして飛び散った虫などの環境によって低下したり、完全に停止したりした場合、障害物の影響を受けにくい(あるいは受けない)別のセンサーからのデータのバックアップが重要になる。

Teslaが2021年5月に「レーダーを廃止しカメラに完全に依存する」と発表して注目を集めているのは、このような理由によるものだ。少し考えれば、Tesla車が泥をかぶって目が見えなくなる状況がどうしても出てくるであろうことは、誰でも分かる。だからこそ、今回のTeslaの決定を一時的なものだと解釈する自動車専門家はほとんどいない。

そこで、前述した通り、XilinxのWillard Tu氏に、障害物の種類が異なる場合の各センサーの挙動について聞いてみた(同社のFPGAは、一部の自動車メーカーでセンサーデータの処理に採用されている)

Tu氏は、「例えば、レーダーがビジョンシステムよりも優れている点は、雨や霧などでレーダーシステムの航続距離が制限されていても、レーダーはそれを切り抜けることができることだと」説明した。

一方で、「泥は特殊だ」とTu氏は続けた。「レーダーは乾いた泥なら簡単に透過するが、湿っている泥はどうだろうか。水は導電性があり、信号をひずませることがある」

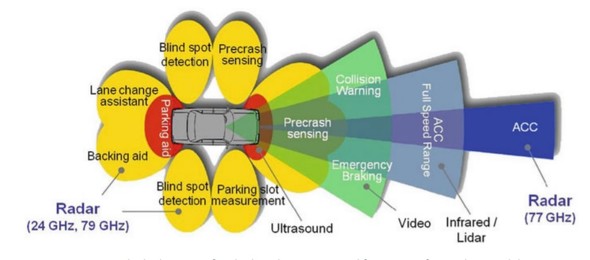

下図は、複数のカメラ、レーダー、LiDARが相互に補完し合う様子を示したものだ。自動車メーカーの中には、この3つを全て評価しているところもあれば、3つのうち2つで済むかどうか(どの組み合わせにするか)を検討しているところも少なくない。Tesla以外で、単一のセンサータイプを検討しているところはほとんどない。

「私は、2種類のセンサーを使うべきだと考えている」とTu氏は述べる。「LiDARとレーダーはどちらも測距が得意だ。カメラはカラーが得意だが、LiDARとレーダーには不可能だ。一方で、LiDARは、文字に十分なエッジがあれば、標識を読み取ることができる場合もある。コストと性能は常にトレードオフの関係にある」(同氏)

「ほとんどの自動車メーカーはカメラを求めている。カメラは安価で簡単だ。LiDARやレーダーはその次だろう」とTu氏は続けた。

しかし、どのセンサーを使うか、あるいはどの組み合わせにするかということよりも、判断は複雑なものになるとTu氏は説明している。

センサーデータが増えれば増えるほど処理能力が必要となる。自動車メーカーは、収集するデータ量と必要な処理能力のバランスを、AIの洗練度に応じて、かなりの余裕を持って調整している。

Tu氏は、「優れたAIが鍵を握っている」と語り、ある画像を示した。それは、Xilinxの顧客が、視界に入る全てのものを正確に識別するために使用したという、実際のセンサー読み取りによる点群だ。この画像を見たとき、われわれは何が写っているのかを想像することすらできなかった。そしてそれは、洗練されたAIであれば、最小限のデータで予想以上の結果を出すことができるということを示していた。

LiDARやレーダーの技術者が、一部分が見えにくいときにAIを活用すると言っているのは、上記のことを意味している。比較的少ないデータでもAIが機能するのと同様に、十分なトレーニングを行えば、通常よりも少ないデータしか得られないという問題をAIで解決することができるのだ。

【翻訳:田中留美、編集:EE Times Japan】

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

自動運転レベルのスペックは行き詰まりか?

自動運転レベルのスペックは行き詰まりか?

2021年5月初め、SAE Internationalは自動車の自動化レベルを再び更新した。更新内容は規格「J3016」で説明されている。J3016で示された分類は最もよく知られ、広く参照されているが、結局のところ、それほど役に立っていないのかもしれない。 自動運転車の安全規格標準化へ、業界超えたWG設立

自動運転車の安全規格標準化へ、業界超えたWG設立

自動運転車のアーキテクチャと標準化の促進に注力する欧州のイニシアチブは、切実に求められている安全性の検討に重点的に取り組んでいる。 米国がADASに関連した衝突事故の報告を義務化

米国がADASに関連した衝突事故の報告を義務化

米連邦政府の規制当局は、ADAS(先進運転支援システム)のメーカーや事業者に対し、衝突事故の迅速な報告を義務付けると発表した。これにより、ADASの監視が強化されることになる。 東芝、ソリッドステートLiDAR向け受光技術を開発

東芝、ソリッドステートLiDAR向け受光技術を開発

東芝は、「ソリッドステート式LiDAR」向けの受光技術と実装技術を新たに開発した。新技術を採用すると、200mの最長測定距離を維持しつつ、従来に比べサイズが3分の1で、解像度は4倍となるLiDARを実現できるという。 Xilinx、エッジ向けVersalプラットフォームを開発

Xilinx、エッジ向けVersalプラットフォームを開発

Xilinxは、7nmプロセスを用いたマルチコアヘテロジニアス演算プラットフォーム「Versal ACAP(Adaptive Compute Acceleration Platform)」の新シリーズとして、自動運転システムなどに適応できるエッジ向け「Versal AI Edge(エッジ)」を発表した。 自動車の“HPC化”が進む、TSMC

自動車の“HPC化”が進む、TSMC

TSMCは2021年6月2日(台湾時間)、自社イベントの「2021 Virtual Technology Symposium」で、5nmプロセスノードの新しいファミリーとなる「N5A」について言及した。N5Aは、「AI(人工知能)対応の運転補助や運転席のデジタル化など、より進化した密度の高い自動車アプリケーションにおける、演算性能への高まる需要を満たすことを目指したものである」だという。