AMD「ROCm」はNVIDIA「CUDA」に対抗できるのか:AMD Anush Elangovan氏(1/2 ページ)

データセンター向けGPUにおいてNVIDIAが強みを持つ理由は、GPUの性能の高さのみでなく、むしろ「CUDA」にある。そこに挑むのがAMDだ。AMDはソフトウェアスタック「ROCm」について、どのような戦略を持っているのか。

AMDが、データセンター向けGPU市場のリーダーであるNVIDIAからシェアを奪い取ることに挑戦しているが、それは、AMDのAIソフトウェアスタック「ROCm」の成功/失敗によって大きく左右されるであろうことは間違いない。世界で最も企業価値が高いNVIDIAの最強の市場優位性とされている、「CUDA」とその膨大なインストールベースに戦いを挑むのは、非常に困難な取り組みではないだろうか。

AMDのAIソフトウェア部門担当バイスプレジデントであるAnush Elangova氏は、米国EE Timesの独占インタビューの中で「(その取り組みは)山を登るようなものだ。一歩ずつ前に踏み出していく。方向性を定め、全力を尽くせば、後はついてくるだろう」と述べる。

同氏は2年半前に、自身が設立したスタートアップNod.aiをAMDが買収したことにより、AMDに加わった。Nod.aiの30人から成る開発チームは、5〜6年間にわたってAIコンパイラの開発に取り組み、「Shark」や「Torch.MLIR」「IREE」などの最も重要なAIリポジトリに大きく貢献したことで広く知られている。Nod.aiは、同社のコンパイラベースの自動化ソフトウェアを使用しているハイパースケーラー企業や、エンタープライズ、スタートアップなどと協業してきた。

EE TimesがROCmについてAMDに最後に話を聞いたのは、Nod.aiの買収直前のことだった。AI部門担当シニアバイスプレジデントであるVamsi Boppana氏はそのインタビューで「ROCmは、AMDにとって一番重要だ。当社のCPUやGPU、FPGAなどの異なるハードウェア全体でAIスタックを統合することを目指している」と述べていた。

Elangovan氏は「それ以来2年半にわたり、継続的にROCmに投資してきた」と述べる。

「ROCmは当時、部品の集合体のようなものだったが、ASICにファームウェアを提供することで成長してきた。ここにファームウェアが1つあって、ここにもファームウェアが1つあるなら、それを連結させてみようという具合だった」(Elangovan氏)

現在のROCmチームは、Elangovan氏がNod.aiを設立する前に所属していた、Google Chromeチームを見習おうとしているという。

Elangovan氏は「Chromeユーザーなら、自分がどのバージョンを使っているかは恐らく分かっていないだろう。それを気にしないのは、そのままで普通に機能しているからだ。われわれは既に、ROCmでその状態を実現しつつある。今後数回のリリースで、リリース周期が6週間になっていく見込みだ。そして、『問題なく機能しているからバージョンは気にならない』という段階に到達するだろう」と述べる。

NVIDIAとAMDのGPU間のポータビリティ、負担は「解消」

Elangovan氏は「ROCmチームは今や、当初の後れを取り戻すことができた。今後も可能な限り迅速に動き続ける必要がある」と述べている。

「当社は現在、ソフトウェアメーカーのようにソフトウェアを出荷し、ソフトウェアメーカーのようにソフトウェアを開発している。そして、次の移行期のために何を行うべきかについても深く理解している。それは、AIアシストエンジニアリングだ」(Elangovan氏)

Boppana氏が約2年半前に語っていたAIスタックの統合は、Elangovan氏とNod.aiチームによって実現されている。Elangovan氏は「社内では『OneROCm』と呼ばれており、一部はまだハードウェア特有のものだが、全てのアクセラレーションがROCmスタックを介して実行される。このため、異なる種類のAMDハードウェア間でポータビリティを実現することが可能だ」と述べている。

「NVIDIAとAMDのGPU間のポータビリティは、2年前には非常に重要なことだったかもしれないが、現在ではより高いスタックで作業する場合が多いため、その負担は解消されている。このような移行の一部は、OpenAIのオープンソースAIフレームワーク『Triton』によって実現されたものだ」(Elangovan氏)

「Triton」が鍵に

Elangovan氏は「当時は、CUDAカーネルをHIPカーネルに変換することが目的だった。しかしTritonへの移行が進み、TritonがGPUプログラミングの優れたイコライザーとなった。この素晴らしいイコライザーを使えば、Tritonカーネルを書いて、AMD/NVIDIAで実行できるようになったのだ。われわれはそこへ集中的に投資した」と述べる。

Nod.aiの主要なエンジニアの1人が、AMDでTritonの取り組みを主導し、OpenAIと密接に協業している。AMDは、アクセラレーター向けのコンパイラーインフラであるMLIRにも多額の投資を行っているという。また、かつてのNod.aiのチームがTorch.MLIRの保守を継続していることから、異なる種類のハードウェア向けにコードをリターゲットすることが可能だという。

Elangovan氏は「CUDAコードからの変換は、もはや一般的なリクエストではなくなった。推論向け顧客の大半は、vLLMやSGLangを使用して、いくつかある大規模言語モデル(LLM)の1つを実行しており、トークン/秒の最大化を実現することだけに集中しているからだ」と述べる。

「当社のチームにはTritonカーネルがあるため、もし予期せぬようなアテンションアルゴリズムが登場したとしても、Tritonで全て対応できるだろう。ただし、1〜2日の間には速度を最適化したバージョンを構築できる。導入のしやすさが同じであることを実証できさえすれば、vLLMをpipインストールして全てを内部に統合することができる」(Elangovan氏)

また同氏は「HIPifyは、現在もHPC(高性能コンピューティング)顧客向けに提供されているが、全般的に、新しいAMDカーネルを書いたり検証する際には、ClaudeのようなAIツールが頼みの綱となっている。Claudeの方がHIPifyよりも優れているのは、Web検索機能を備えているからだ」と述べる。

ROCmは100%オープンソースだが、ファームウェアはその範囲には含まれない。Elangovan氏は「ROCmは、オープンソースであるために開発コミュニティーから徹底的に監視されることになるが、それはROCmが、AMDではなくコミュニティーのイノベーションと同じ速さで進んでいけるということを意味する。こうして、ROCmを選択して自由に活用し、イノベーションを実現することができるのだ」と述べる。

「コンパイラであれランタイムであれ、誰もが自分の好きなスポットで利用することができる。それを制限するのは、AMDがいかに迅速に連携できるかどうかではなく、自身の能力だ」(Elangovan氏)

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 中国SiCの進化「日本は追い付けないレベル」 競わず活用を

- 日本メーカー製、でも中身は……カメラなど最新6製品を分解

- Lam ResearchがPLP特化拠点 「共に未来を」とRapidus

- キオクシア25年度 驚異の決算 Q4純利益は前年比30倍

- 「ディスプレイ1本では経営厳しい」 起死回生図るJDIの戦略

- AI半導体で「パネルは新たなフロンティア」、Lamの装置戦略

- 社会人大学院生にしか見えない「ドブ板経験」と「学問」のあいだ

- AI時代を切り開くNVIDIAの戦略に脱帽 受注残1兆ドル超の衝撃

- AI用半導体とメモリの奪い合いに 自動車業界が供給難に直面

- 立体配線でSiCの体積/損失を半減 富士電機の新パッケージ技術

Anush Elangovan氏 出所:AMD

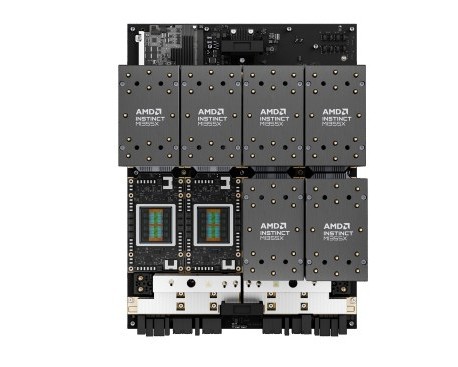

Anush Elangovan氏 出所:AMD AMD「Instinct MI355X」 出所:AMD

AMD「Instinct MI355X」 出所:AMD