IC設計にもAIを、配置配線が機械学習で加速化する:ISSCC 2020(1/2 ページ)

Googleは、米国カリフォルニア州サンフランシスコで2020年2月16〜20日に開催された「ISSCC 2020」において、機械学習(ML)を使用してIC設計で配置配線を行う実験を行ったところ、優れた成果を得られたと発表した。

AIを配置配線に活用

Googleは、米国カリフォルニア州サンフランシスコで2020年2月16〜20日に開催された「ISSCC 2020」において、機械学習(ML)を使用してIC設計で配置配線を行う実験を行ったところ、優れた成果を得られたと発表した。これは、回路設計だけでなくAI(人工知能)分野にとっても、重要な成果である。

AIはここ数年間で、エレクトロニクス業界における最重要分野となり、膨大な量の半導体研究が行われ、ベンチャーキャピタルやメディアからの注目も集めている。ISSCC 2020は主題として、「Integrated Circuits Powering the AI Era(AI時代を駆動する集積回路)」を掲げ、オープニングの本会議では、AIが半導体分野をどの程度までけん引しているのかを位置付けるための議論がなされた。

本会議ではその一例として、4人の登壇者たちが、「AIに対する要求によって、AI専用という新しい分野のチップ開発が加速している。これを受けて、構造の中のイノベーション(例:チップレット、マルチチップパッケージ、インターポーザ)が加速し、量子コンピューティングの開発にも影響が及んでいる」と説明している。

Google AIのトップを務めるJeff Dean氏は、本会議において最初に登壇し、MLの概要について最新情報を提供した。同氏はこれまで1年以上にわたり、こうした情報をさまざまな形で提示し、配置配線にMLを活用する議論の発展を目指してきた。

同氏は最初に、AIの歴史について大まかに振り返り、まずは1995年にバックギャモンのプレー方法を学習したマシンについて取り上げた。さらに、チェスや囲碁の学習を得意としていたマシンが、今や「StarCraft」などの複雑なビデオゲームをうまくこなし、目覚ましい成果を達成するまでになったことを語った。MLは現在、医療画像やロボット工学、コンピュータビジョン、自動運転車、神経科学(脳の断層写真の顕微鏡分析)、農業、気象予報など、さまざまな分野で利用されている。

これまで数十年間にわたりコンピューティング分野をけん引してきた基本的な考え方は、「問題が大きければ大きいほど、より高い処理能力を投入する。処理能力が高ければ高いほど、より大きな問題を解決することができる」というものだ。この考え方はしばらくの間、AIを使った問題解決にも適用されていた。

だが、気が遠くなるほど問題空間が膨れ上がり、それを解決できるだけの十分なCPU(またはGPU)を単純に集積することができなくなったため、この考え方は崩壊した。

AIチップは、CPU/GPUほど複雑じゃなくてよい

ところが、AIには、一般的なCPU/GPU性能が必ずしも必要ではないことが分かってきた。必要なのはシンプルな計算能力であり、精度もそれほど高くなくてよい。こうして、「AI専用プロセッサは、CPUやGPUのように複雑である必要はない」という“予期せぬ”結論に至ったのである。

このような洞察から、推論向け専用のプロセッサが開発されることになった。例えば、Googleの独自開発プロセッサ「TensorFlow」は、現在第3世代が投入されている。同社は、近いうちに第4世代のTensorFlowを発表するのではないか、ISSCC 2020で何か重大な発表を行うのではないかという期待を集めていたが、その当ては外れた。

「必ずしも高い精度が必要ではない」ことは、推論だけでなく学習向けにもいえる。これは、比較的新しい見解である。EE TimesのSally Ward-Foxton記者は、コラム「Artificial Intelligence Gets Its Own System of Numbers(AI独自のシステムナンバー)」で、この考え方について説明している。

Dean氏は、「AIプロセッサは比較的シンプルなので、(ハイエンドGPUなどに比べると)安価だ。今や、膨大な量のデータセットでも高速トレーニングを実行できるだけの性能を備えたAIプロセッサが開発されている。このため、MLをさらにネットワークエッジへと容易に進出させていくことが可能だ。その具体例として挙げられるのが、音声認識である。Googleは2019年の時点で、既にスマートフォンでも動作できるほど小型なモデルを用意していた」と述べている。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- 「画素の製造もパートナーと」十時氏が語る、ソニー×TSMC合弁の狙いと期待

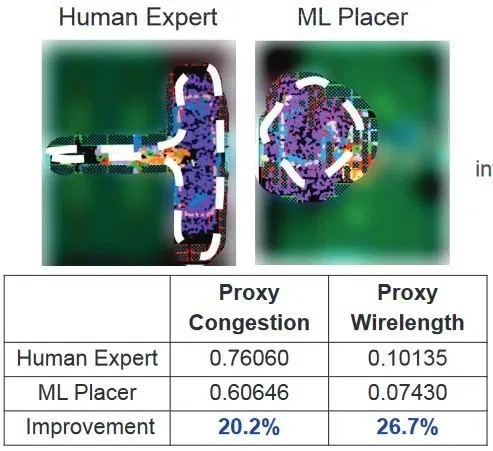

エンジニアが配置配線を行った場合(左)と、AIが行った場合の比較 出典:Google

エンジニアが配置配線を行った場合(左)と、AIが行った場合の比較 出典:Google