”基盤モデル”に照準、SambaNovaの新世代RDU:処理能力688TFLOPSのプロセッサ(2/3 ページ)

基盤モデルの持つ可能性

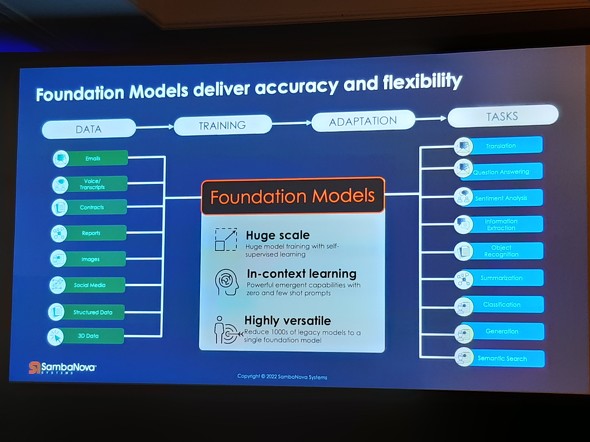

「基盤モデル(foundation model)」は、スタンフォード大学の基盤モデル研究センター(Stanford Center for Research on Foundation Models)で作られた用語で、特殊な種類の大規模言語モデルを指す。十分に大量かつ多種多様なデータの上で基盤モデルを学習させると、例えば質問応答、要約、感情分析といった多様なタスクを含め、複数の言語ベースのタスクの実行に適応できるようになる。

Olukotun氏は「従来のタスク中心の機械学習では、タスクごとに特定のモデルを学習させる必要があったが、これは破綻している。基盤モデルは、そうした従来の機械学習モデルを完全に過去のものにする。基盤モデルを使えば、単一のモデルを取り出して、それを特定のタスクに適応させることができる。それにより、タスクに特化した数千もの個別モデルを単一のモデルに置き換えることができる。つまり、管理がより容易になる上に、AI能力をこれから発生する新たなタスクにマッチするように一層簡単に変換できるようになる」と述べた。

基盤モデルの課題を解決するSambaNovaの技術

基盤モデルの規模は、一般的に100億パラメータより大きくなるため、利用を希望する企業にとって課題となっている。

SambaNovaの共同創業者兼CEO(最高経営責任者)であるRodrigo Liang氏は「実際にハードウェアリソースを集約し、ソフトウェアを正しくプログラミングし、さらに実際に機械を正しく学習させた上でそれを配備/保守したり、モデルの学習や推論、持続的な管理を行ったりするほどの専門知識を得ることは容易ではない」と述べた。

今日の技術を使ってゼロから基盤モデルを学習させるには、数カ月かかる可能性がある。SambaNovaは、あらかじめ学習させたモデルをハードウェアと共に供給し、その期間を短縮できるよう狙う。それらを用いると、企業はあらかじめ学習させたモデルを独自のプライベートデータ上で微調整できるようになり、顧客がそのモデルを使って行うタスクの精度を高めることができるという。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 中国SiCの進化「日本は追い付けないレベル」 競わず活用を

- 日本メーカー製、でも中身は……カメラなど最新6製品を分解

- Lam ResearchがPLP特化拠点 「共に未来を」とRapidus

- キオクシア25年度 驚異の決算 Q4純利益は前年比30倍

- 「ディスプレイ1本では経営厳しい」 起死回生図るJDIの戦略

- AI半導体で「パネルは新たなフロンティア」、Lamの装置戦略

- 社会人大学院生にしか見えない「ドブ板経験」と「学問」のあいだ

- AI時代を切り開くNVIDIAの戦略に脱帽 受注残1兆ドル超の衝撃

- AI用半導体とメモリの奪い合いに 自動車業界が供給難に直面

- 立体配線でSiCの体積/損失を半減 富士電機の新パッケージ技術