AIの競争軸は半導体から電力へ――日本の戦略の「死角」に:湯之上隆のナノフォーカス(88)(1/4 ページ)

AIの競争軸は、半導体から電力へと移りつつある。なぜなら、AIに必要な計算能力の拡大が、半導体の性能向上よりも速いペースで電力需要を増大させているためである。これは、日本の半導体戦略において見落とされがちな「死角」でもある。

AI競争の構造転換

2021年に1451億米ドルだった世界のデータセンター投資は、2027年に9000億米ドル超に達する見込みだ。しかし、今この巨額投資の出発点になっているのは、GPUなどのAI半導体の調達計画ではない。「どれだけの電力を確保できるか」である。

Microsoftは過去の事故で停止していたスリーマイル島(TMI:Three Mile Island)原発の再稼働を支援し、Amazonは小型モジュール炉(SMR:Small Modular Reactor)に出資した。AI企業が、なぜ発電所に投資するのか。

理由は単純だ。半導体の性能がいくら上がっても、電力がなければAIは動かない。そして今、世界のAIが必要とする電力の増加速度は、発電所の建設速度をはるかに超えている。

本稿では、この構造転換を「計算量の増大」「電力消費の爆発」「発電能力の限界」という3つの数字で検証する。そして最後に、半導体戦略に注力しているにもかかわらず、エネルギー戦略との統合を欠く日本の死角を問う。

データセンター投資が示す異変

図1の世界データセンター設備投資額の推移を見ると、2024年前後から明らかな変曲点が現れている。2021年に1451億米ドルだった投資額は、2027年には約9000億米ドルに達する見通しだ。単に規模が大きいというだけではない。増加の傾きそのものが変わっている。

さらに注目すべきは、何に資金が投じられているかである。数年前まではAI半導体としてのGPUやサーバなどのIT機器が投資の中心だった。ところが最近の建設計画を見ると、最初に議論されるのは受電容量であり、変電所の増設であり、冷却設備(廃熱設備と呼ぶこともある)である。つまり、「どれだけ計算したいか」ではなく、「どれだけ電力を確保できるか」が出発点になっているのだ。

データセンターは、今や巨大な電力消費装置である。計算能力の拡張は、半導体の製造能力よりも、送電網と発電設備の能力によって、制約を受け始めている。この点については、後段で「発電能力の限界」として詳しく検証する。

「半導体の進化」が電力増に追い付かない

半導体の進化により、GPU1基当たりの演算性能は飛躍的に向上してきた。NVIDIAのデータセンター向けGPUを例にとれば、2016年の「P100」から2024年の「B200」まで、同一条件で比較しても8年間で約100倍の演算能力向上が実現されている。

この演算性能の向上に伴い、電力当たりの演算効率(FLOPS/W)も着実に改善されてきた。実測ベースでは、おおむね「2年で2倍」のペースで推移しており、ムーアの法則と同等のペースである。

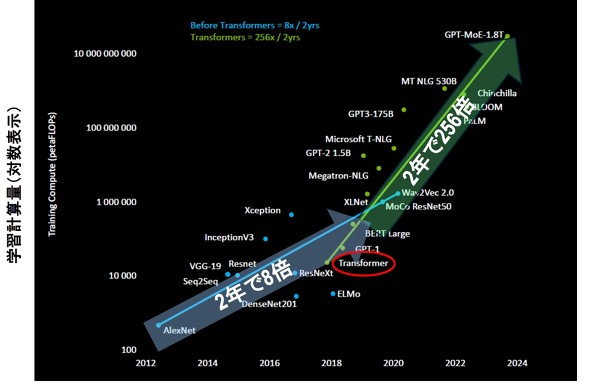

しかし、この効率改善をもってしても、AI全体の消費電力は減るどころか加速度的に増加している。その原因は、モデルの大規模化に伴う計算量の増大が、効率改善の速度を大幅に上回っているためである(図2)

図2 AI学習に必要な計算量の指数的増大(「2年で8倍」から「2年で256倍へ」と加速)[クリックで拡大] 出所:NVIDIA, “NVIDIA’s Blackwell Architecture, Powering the AI Factory,” (2024)のスライドに筆者加筆

図2 AI学習に必要な計算量の指数的増大(「2年で8倍」から「2年で256倍へ」と加速)[クリックで拡大] 出所:NVIDIA, “NVIDIA’s Blackwell Architecture, Powering the AI Factory,” (2024)のスライドに筆者加筆2012年のAlexNet以降、AIモデルの学習に必要な計算量は「2年で8倍」のペースで増加してきた。ところが、前掲図2に示されているように、2017年にGoogleが発表したTransformerアーキテクチャを起点として、GPT-2、GPT-3といった大規模言語モデル(LLM)が次々と登場し、パラメータ数の増加とともに学習に必要な計算量の増加ペースは「2年で256倍」へと急激に跳ね上がった。

具体的に計算すると、需要が256倍に膨らみ、効率が2倍に改善されても、差分の128倍は電力増として跳ね返る。これが、半導体の微細化だけではAIの電力問題を解決できない構造的理由である。

なお、この「2年で256倍」は、最先端モデルの学習に必要な計算量の上限的な推移であり、全てのAI利用に一律に当てはまるわけではない。しかし、国家レベルの電力需要を決定づけるのは、まさにこの最先端モデルの学習と推論であるため、電力計画においてはこのフロンティアの数字が意味を持つ。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

![図1 データセンターへの設備投資の推移[クリックで拡大] 出所:TrendForceのデータをもとに筆者作成](https://image.itmedia.co.jp/ee/articles/2603/12/mm20316_nano01.jpg)