AIの競争軸は半導体から電力へ――日本の戦略の「死角」に:湯之上隆のナノフォーカス(88)(2/4 ページ)

計算量の加速が意味するもの

前掲図2の対数グラフで、傾きが急に立ち上がるということは、成長の法則そのものが変わったことを意味する。Transformerの登場以降、パラメータ数の増加だけでなく、学習データの増大、反復的な強化学習といった学習段階の要因に加え、大規模モデルの普及に伴う推論需要の爆発的な拡大も重なり、AIが消費する総演算量は複合的に膨張している。

ここで重要なのは、演算効率の改善が「1回当たりの計算コスト」を下げても、「総計算回数」が爆発的に増えれば、最終的な電力消費量は増え続けるという点である。半導体技術の進歩が止まったわけではない。むしろ進歩は続いている。しかし、それを上回る速度で、AIが要求する計算量が増えているのである。

半導体の消費電力を下げる「余白」は、ほとんど残されていない

半導体チップの消費電力は、物理法則によって決まる。現代の半導体チップのほぼ全てに使われているCMOS回路――pMOS(正孔で動くトランジスタ)とnMOS(電子で動くトランジスタ)を相補的に組み合わせた回路構造――の動的消費電力は、次の式で表される。

P = α × C × V2 × f

P:消費電力

α:スイッチング活性率――回路がどれだけ頻繁にオン・オフを切り替えるかの割合

C:負荷容量――トランジスタが信号を切り替える際に充放電する電気的な容量

V:電源電圧――チップに供給する電圧。2乗で効くため、消費電力への影響が最も大きい

f:動作周波数――1秒間にチップが処理を繰り返す回数(クロック周波数)

この式が意味するのは、消費電力を下げるには、C、V、fのいずれかを小さくするしかないということである。

微細化が進めばトランジスタは小さくなり、容量Cは減少する。しかし、電圧Vには下限がある。トランジスタを確実にオン・オフするために必要な最低電圧(しきい値電圧)が存在するためだ。しかも電圧は2乗で消費電力に効くので、ここが下がらない影響は大きい。周波数fも上げれば上げるほどチップの発熱が増すため、既に頭打ちの状態にある。

つまり、半導体の消費電力を下げる「余白」は、物理的にほとんど残されていない。チップ単体の電力効率は世代ごとに改善されてきたが、その改善幅には限界がある。AIの計算量が「2年で256倍」に急増する世界では、チップの省電力化だけで需要の爆発を吸収することは、もはや不可能である。

電力問題が「厄介」な理由

電力問題を厄介にしているのは、チップの消費電力だけが問題ではないという点である。データセンターでは、サーバやGPUの消費電力に加え、冷却装置、電力変換設備、ポンプ、ファンなどの補機類も相当量の電力を消費する。

この「施設全体の電力負担」を測る指標が、PUE(Power Usage Effectiveness:電力使用効率)である。PUEは、施設全体の消費電力をIT機器の消費電力で割った値で定義される。例えばPUEが1.2であれば、IT機器が100の電力を消費する場合、施設全体では120の電力が必要になる。差分の20は、冷却(廃熱)や電力変換損失などに費やされる。

最新の大規模データセンターでは、PUEは1.1程度まで改善されている。しかし、それでも10%以上の上乗せは避けられない。しかも今後は、改善どころか悪化圧力がかかる可能性すらある。GPUの高集積化に伴い、チップ当たりの発熱量が急増しているからだ。

この発熱に対処するため、従来の空冷に代わる液冷システムの導入が加速している。液冷は空冷より廃熱効率が高い一方で、冷媒循環ポンプや熱交換設備などの新たな補機電力を必要とする。その結果、高密度化が進むほどPUEの改善余地は縮小していくという構造的な悪循環が生じることになる。

従って、国家が確保すべき電力量は、GPUなどのAI半導体単体の消費電力にとどまらない。施設全体のこうした上乗せ分を含めた総量で計算しなければならない。チップレベルの効率改善だけでは、最終的に必要な電力量の桁は変わらないのである。

モデル学習が消費する電力

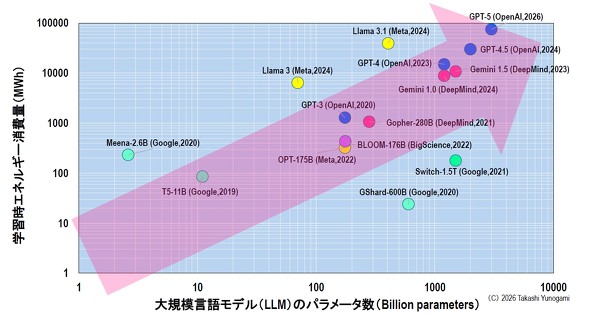

図3は、主要なLLMの学習(トレーニング)に要した電力量を示したものである。主なLLMとその電力量を挙げてみよう。

- GPT-3(2020年):約1287MWh

- GPT-4(2023年):約1万MWh超

- Llama 3.1:約3万MWh

- GPT-5(推定):5万MWh超

図3 主要大規模言語モデルのパラメータ数と学習時エネルギー消費量の関係[クリックで拡大] 出所:OpenAI、Meta、Google DeepMind、BigScience等の公開論文・技術報告・企業発表資料を基に筆者作成(対数軸表示)

図3 主要大規模言語モデルのパラメータ数と学習時エネルギー消費量の関係[クリックで拡大] 出所:OpenAI、Meta、Google DeepMind、BigScience等の公開論文・技術報告・企業発表資料を基に筆者作成(対数軸表示)半導体の電力効率(FLOPS/W)は、前述の通り「2年で2倍」のペースで着実に改善されてきた。5年間で計算すれば、同じ計算を約5分の1〜6分の1の電力でこなせるようになった。

しかし、モデルの大規模化が要求する計算量の増加は、それをはるかに上回る。GPT-3(2020年)の学習に必要だった電力は約1300MWhであり、GPT-5(推定2025年頃)では5万MWhを超えると見積もられている。効率が5年間で5〜6倍に改善されてもなお、消費電力は約40倍に膨らんでいる。効率改善を織り込んでこの数字である。

さらに、データセンターの冷却や電力変換に伴う上乗せ分(PUE)を加味すれば、実際の電力需要はこれより大きくなる。

チップ技術の進歩が無意味なのではない。それだけでは足りないということだ。結局のところ、必要なのは電力供給そのものの拡大である。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 「装置は動くがプロセスが成立しない」――He供給危機とナフサ不足の本質

- He/ナフサ供給危機で工場新設も遅延? 装置/チップメーカーへの波及経路を探る

- 最新ノートPC5機種を分解 新旧MacBook Proの中身の違いは?

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- 「AI特需」の恩恵届かぬ日本企業 Gartnerが見る2026年半導体市場

- 「Rapidusの隣」に光電融合パッケージ開発拠点、28年度の完成目指す

- Apple新CEOはエンジニア出身 製品開発重視への回帰か

- ローム・東芝・三菱電機のパワー半導体はどうなるか

- シリコンフォトニクスと先進パッケージの統合が描く未来