被災地で早期救助を可能にする画像認識システム:どこに、どのような物体があるかを自動で識別(1/2 ページ)

信州大学と東北大学の研究グループは、遠隔操作ロボットで撮影した被災地などの映像から、捜索/救援活動に有用な情報を得ることができる画像認識システムを開発した。

捜索対象の領域絞り込みなどにも高い効果

信州大学の山崎公俊助教とアーノード・ソービ研究員、東北大学の田所諭教授らのグループは2016年9月、被災地などで作業を行う遠隔操作ロボットで撮影した映像から、捜索/救援活動に有用な情報を得ることができる画像認識システムを開発したと発表した。

研究グループは、内閣府総合科学技術・イノベーション会議が主導する革新的研究開発推進プログラム(ImPACT)タフ・ロボティクス・チャレンジの一環として、災害現場ですぐに利用できる捜索活動補助のための画像認識システムを研究/開発してきた。特に田所氏はこれまで、災害ロボット分野の研究で世界をリード。山崎氏は布など不定形物の認識/操作に関する研究で成果を上げてきた。研究成果は両者が協力し、これまで培ってきた技術を活用し発展させることで実現した。

研究グループは今回、映像から認識能力を得る処理(学習処理)を効率化し、限りある映像から意味のある情報を抽出するための機能(画像認識器)を開発した。この技術により、初めての被災現場でも素早い対応を可能とした。また、瓦礫(がれき)などの材質を推定する技術や、その表面状態(ぬれているか、土で汚れているかなど)を数値化する技術も開発した。これらの技術を活用することで、崩れやすい場所や滑りやすい場所なども発見しやすくなり、二次被害を防ぐことが可能となる。

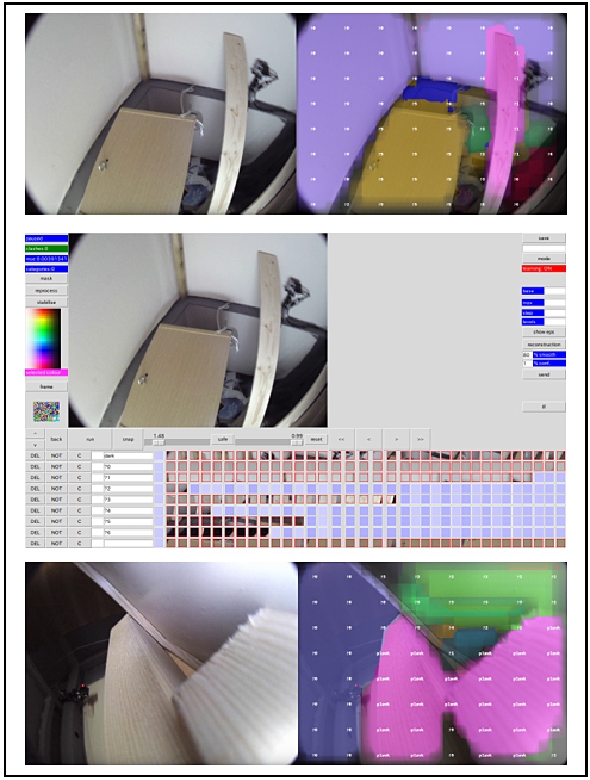

今回の研究成果は、大きく3つに分けることができるという。その1つは「現場に素早く対応できる認識システム」の開発である。ヘビ型ロボットの先端に取り付けたカメラで撮影し、この画像データを開発した技術で処理する。入力映像に対して1つのまとまりとみなせる領域を検知し、その領域を色付けして強調する。その部分が意味のある領域と判断できる場合に、操作者はその領域にカテゴリー名を付ける。この作業を行うことで、開発したシステムが対象となる領域を学習し、同じカテゴリーに所属する可能性が高い領域は同じ色で強調できるようになるという。

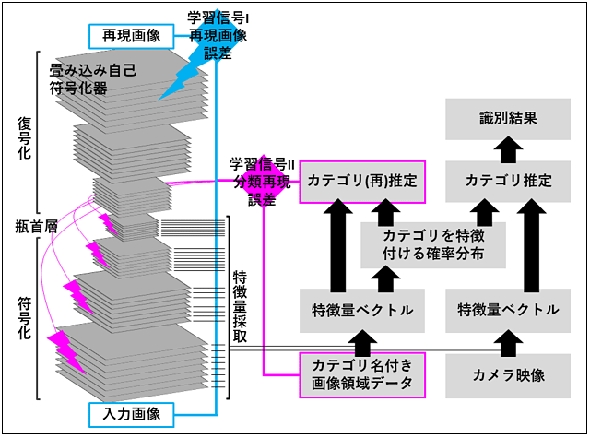

研究グループは、これらの処理を実現するため、畳み込み自己符号化器(以下、符号化器)と呼ばれるニューラルネットワークを開発した。符号化器は、入力した画像を分割した小さな画像領域から、カテゴリーの区別を明確にする「特徴ベクトル」を生成する。これが、操作者が名付けたカテゴリーの特徴ベクトルと類似した画像領域であれば、同一のカテゴリー名とする。

なお、符号化器は2つの学習プロセスを並行して実行するという。1つはカテゴリー情報が与えられていない訓練データから有意な法則を抽出する手法(教師なし学習)を用いて、入力画像の圧縮・展開を学習させる方法である。

表現ずらし

もう1つは、新たに開発した「表現ずらし」という学習方法である。カテゴリー名が付与された画像領域から特徴ベクトルを得たあと、カテゴリーの「類似性」に基づいてその特徴ベクトルを少しだけ操作する。システムが自動で付与したカテゴリー名が、操作者から付与されたカテゴリー名と合致しない場合、誤ったカテゴリー名が付与された画像領域の特徴ベクトルと、実際のカテゴリーに所属する画像領域の特徴ベクトルの距離が増えるように、符号化器の更新処理を行うという。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- 「画素の製造もパートナーと」十時氏が語る、ソニー×TSMC合弁の狙いと期待

画像認識システムの利用例 出典:信州大学、東北大学他

画像認識システムの利用例 出典:信州大学、東北大学他 符号化器の構成と学習プロセス。青線が「教師なし学習」、紫線は「表現ずらし学習」を示す 出典:信州大学、東北大学他

符号化器の構成と学習プロセス。青線が「教師なし学習」、紫線は「表現ずらし学習」を示す 出典:信州大学、東北大学他