不幸な人工知能 〜尊敬と軽蔑の狭間で揺れるニューラルネットワーク:Over the AI ―― AIの向こう側に(21)(4/9 ページ)

「バックプロパゲーション」を数式抜きで解説する

さて、ここからは、ニューラルネットワークの概要と、第2次AIブームの端緒を開いた、「逆伝搬学習 ―― バックプロパゲーション」について、数式抜きの解説を行いたいと思います。

ニューラルネットワークとは、

―― ごたくはどうでもいいから、とっとと丸暗記しやがれ

を可能とするAI技術、と理解していただいて問題ありません。

これをエンジニアの視点から見れば、「その原因と結果を導く、『何か』を、論理化したり、数値化したり、コーディングしたりするのが面倒な訳よ。そういうものから、手を抜きたい訳よ。ドゥー・ユー・アンダスタンド?」です。

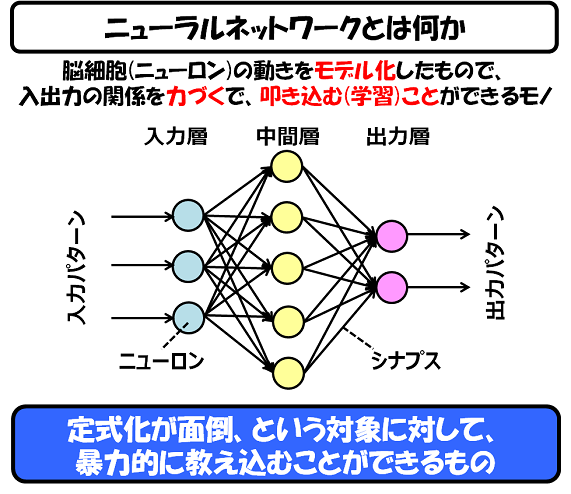

で、これを、もう少しだけ、穏当な用語に置き換えて、図式化したものが以下になります。

上の図は、脳細胞のメカニズムに良く似ています。生物の脳も、ニューロンという脳細胞が、シナプスという電気信号線で接続したもので構成されています。

ニューラルネットワークの研究は、

(Step.1)脳の構造に似ているからマネしてみた(ニューロン発火とか、シナプス強化)

(Step.2)マネしてみたら、入力と出力のパターンを覚えさせることができることが分かった

(Step.3)(特に)ショボい数のニューロンでも、非線形分離を取り扱えることや、追加して学習データを覚えさせられることが分かった

―― という経緯を経て、今に至っています。

私が、30年前に、ニューラルネットワークこそが、「強いAIのベースとなる*)」と確信してしまったのは、仕方がないと言えるでしょう(と、言い訳をする)。

関連記事:「弱いままの人工知能 〜 “強いAI”を生み出すには「死の恐怖」が必要だ」

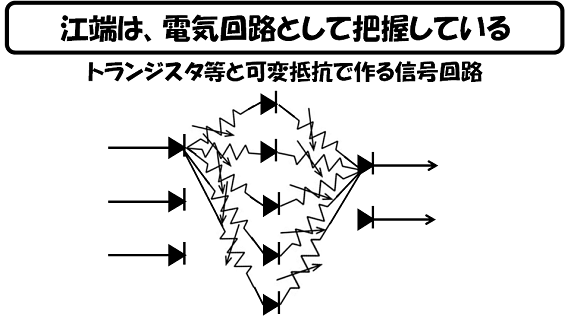

ちなみに、私は、ニューラルネットワークを電気回路のパラダイムで理解しています。

ある一定の電流量を超えたら、電気信号を出力する非線形素子(ダイオード、トランジスタ、オペアンプ)と、学習に応じて値を変動させ続ける線形素子(可変抵抗)からなる電気回路です。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ソニー半導体、26年度は減収見込み メモリ市況不透明

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- ペロブスカイト/CIGSタンデム太陽電池で「世界最高」効率達成、東京都市大ら

- 「画素の製造もパートナーと」十時氏が語る、ソニー×TSMC合弁の狙いと期待

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- DRAM不足で変わるAIシステム設計 エッジAIや特化型モデルに追い風

- ソニーセミコンとTSMCが合弁会社設立を検討

- 半導体検査装置向けレンズの研磨工程が稼働、生産能力2.6倍に

- 26年3月の世界半導体市場は79%増、日本も10カ月ぶりプラス成長