NEC「予測の根拠を説明できる人工知能」を強化:分散処理技術の適用に成功(2/3 ページ)

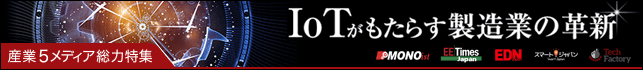

並列処理できず、対象データ規模に制約

予測の根拠を説明できる異種混合学習技術だが、大きな課題もあった。それは、処理が複雑な上、並列処理が行えないという点だ。そのため、1つのCPUコアでの処理に限られ、元のデータ量が増えるとそれだけ処理時間が延びることになり、適用用途が限られた。

「Apache Spark」で分散処理を実現

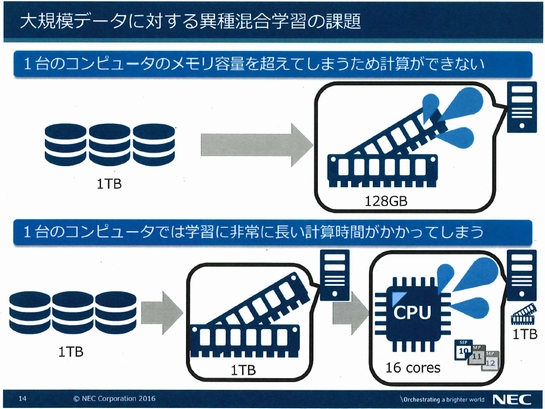

今回、NECが開発した技術は「分散版異種混合学習技術」であり、その名の通り、分散コンピューティングシステムで、大規模データを高速処理する技術だ。

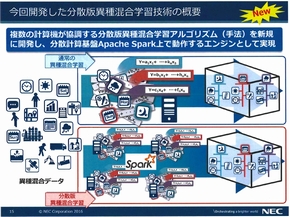

分散版異種混合学習技術では、「ドライバー」と呼ぶ1つのCPUコアがシステム全体を統括する司令塔役を務める。そしてそのドライバー下に、「エクスキューター」と呼ぶ異種混合学習処理を行うCPUコアが配置され、それらエクスキューターはランダムに割り当てられるデータに対し、それぞれ別個に異種混合学習処理を行い、データの場合分け、予測するための変数(因子)の組み合わせを行い予測モデルを生成する。エクスキューターがそれぞれ生成した予測モデルをドライバーが集めて統合。その統合した予測モデルを各エクスキューターに戻し、さらに各エクスキューターが異種混合学習処理を行いより高精度な予測モデルを生成するといったことを繰り返し、高精度な予測モデルに仕上げていく。

こうした分散コンピューティング基盤として、University of California at Berkeley(カリフォルニア大学バークレー校)で開発されたオープンソースデータ処理フレームワーク「Apache Spark」を利用し、実現したという。

「この仕組みにより、分析対象データは、各エクスキューターのメモリ上に分散配置すると、それ以降再配置や再読み込みの必要がなく、大容量の通信を必要としない。ドライバーとエクスキューター間でやりとりされるのはキロバイト〜メガバイト程度のモデル情報だけで済む。エクスキューターを増やすだけで、大規模な分析対象データを高速に処理できるようになった」とする。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 村田製作所、25年度は売上高が過去最高 データセンター向けは70%増