買収ではなく提携に、SambaNovaとIntelの狙い:第5世代チップ「SN50」の詳細も(3/4 ページ)

価格はエージェント型AI向けGPUの3分の1で高速、ソフトバンクが採用へ

SambaNovaが発表した第5世代チップSN50は、競合製品と比べて5倍高速化するとともに、エージェント型AI向けGPUの3分の1の価格化も実現するという。ソフトバンクが、このSN50を最初に採用する顧客企業になる見込みだ。

Liang氏は「SN50は、マルチエージェントワークフローにおけるLLMトークン生成向けに開発されている。数々のカスタムエージェントを備えたエージェンティックアプリケーションは、レイテンシ要件が非常に低く、企業にとっては法外な運用コストが生じることになる」と述べる。

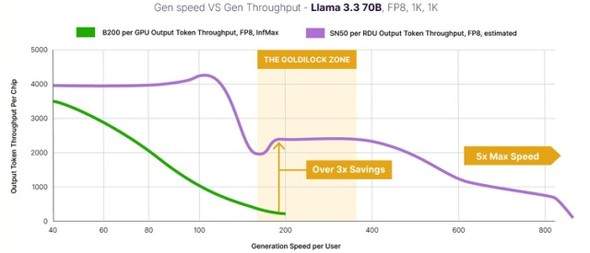

「SN50は、レイテンシとスループットを提供しつつ、サービスプロバイダーのトークノミクスを適正な水準に保つ“ゴールデンゾーン”を実現できる」とLiang氏は述べた。「ここ数年見てきたのは、極めて高速だがサービスプロバイダーが収益化できないか、あるいは経済性を確保するために極端にバッチ処理を行い、エンドユーザーへの遅延が発生するかのどちらかだ。SambaNovaの顧客はこれを適切で収益性のある推論サービスへと転換できる」(同氏)

SambaNovaのチーフアーキテクトであるSumti Jairath氏は、エージェント型推論への新たな注力によって、SN40Lと比べていくつかの重要な変更が加えられたとEE Timesに語った。

SN50は、SambaNovaの従来のLLM推論アクセラレーターであるSN40Lと同じデータフローアーキテクチャおよび3層メモリ階層を採用している。チップ当たりの演算性能を向上させ、低精度演算への対応を追加し、新たな独自インターコネクトプロトコルによってスケールアウトをさらに強化している。これらの変更は全て、エージェントシステムにおける高速トークンのインタラクティビティと経済性を高めるものだ。

エージェントシステムでは複数のモデルを呼び出す必要があるが、通常それらのモデルは異なるチップやシステムに分散している。現在は個々のマシン上にエージェントを配置した複数ラックを構築する必要があり、特定のエージェントが呼び出されている間、ほとんどのハードウェアが実質的に待機状態となるため、極めて非効率的だ。「これが現在のエージェントシステムの制約要因だ」とJairath氏は述べる。

同氏は「全てのモデルとパラメーターを同一マシン上に配置し、必要なモデルを自由に呼び出せるようにすることが求められているのではないか」とも付け加えた。

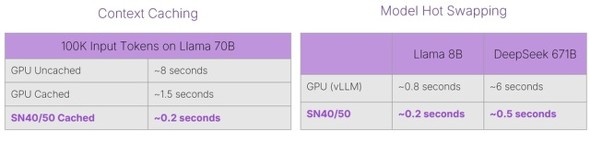

SambaNovaの3層メモリ階層は、プロンプトキャッシングを用いて多数のリクエストに対応しながら複数モデルを実行する「エージェント型キャッシング」をサポートする。

SN50のメモリ構成はSN40Lと同じだ。つまり、1.5Tバイト(B)のDDR5 DRAM、520MBのSRAM(両方の演算チップレット合計)、64GBの広帯域メモリ(HBM)だ(HBM3を採用)。

Liang氏は「HBMの使い方はNVIDIAとは異なる」と語る。「当社は大容量のDRAMを隣接配置しているため、HBMを単なる容量としてではなくホットキャッシュとして使用している。コストと供給状況を考慮し、HBMは前世代を採用している。最新GPUとHBMを巡って競合したくない。当社は前世代品で性能を達成できるため、望む経済性を実現できる」と語った。

GPUはHBMのメモリ帯域幅利用率が低いことで知られているが、Jairath氏はその理由を「新しいカーネルの起動や同期処理にある」と指摘した。SambaNovaにおける良好な利用率は約90%に近いという。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 中国SiCの進化「日本は追い付けないレベル」 競わず活用を

- 日本メーカー製、でも中身は……カメラなど最新6製品を分解

- AI半導体で「パネルは新たなフロンティア」、Lamの装置戦略

- 立体配線でSiCの体積/損失を半減 富士電機の新パッケージ技術

- AI用半導体とメモリの奪い合いに 自動車業界が供給難に直面

- AIデータセンター投資は既に破綻しているのか

- そっと触るだけで光る レアアース不要、電源不要の近赤外発光

- Lam ResearchがPLP特化拠点 「共に未来を」とRapidus

- 「ディスプレイ1本では経営厳しい」 起死回生図るJDIの戦略

- 「透明ナノシート」で作る光センサー 400℃でも安定動作