自動運転車の安全はどう認証すべきか(前編):米運輸用がガイドラインを発表(2/2 ページ)

自動運転車の安全性をテストで証明できるのか

米運輸局(DMV:Department of Motor Vehicles)は、人間に対し運転免許を与えるための試験を実施する機関である。しかし、無人の自動運転車の場合、機械を認証するための試験を行うには、どの機関が適しているのだろうか。さらに、現段階で、適切な試験そのものが果たして存在するのだろうか。

米カーネギーメロン大学(CMU:Carnegie Mellon University)のPhilip Koopman教授は、「最も重要な点は、“自動運転車の安全性をテストで証明できるのか”ということだ」と指摘する。

Koopman氏は、CMUの学部生に組み込みシステムについて、院生にセーフティクリティカルな組み込みシステムについて指導している。同氏は、CMUのロボット工学研究所(Robotics Institute)の商用部門である「National Robotic Engineering Center(NREC)」の研究チームで、自動運転車の安全性の調査や、ストレステストの開発、セーフティシャットダウンボックスや自動運転車の研究を指揮した経歴を持つ。

Koopman氏は、2016年4月12〜14日に米国ミシガン州デトロイトで開催された「SAE 2016 World Congress*)」で「Challenges in Autonomous Vehicle Testing and Validation(自動運転車のテストと検証における課題)」と題する講演を行った。同氏は、同講演を聴講する自動車エンジニアに向けて「自動運転車が適切に動作することを実証するのは非常に難しい。安全を実現するためには、テストを行うだけでは不十分だ」と警鐘を鳴らした。

*)航空機、自動車、商用車業界の関連技術の技術者や専門家が情報の共有や標準の策定を進める非営利団体SAE Internationalが開催する年次会議

Koopman氏はEE Timesの電話インタビューで、「テストが重要ではないという意味ではない」とはっきりと述べた。「もちろん、テストは必要だ。しかし、テストは安全性を証明するものでなく、適切に動作するかどうかを確認するものだ。安全性の課題に対する答えは、より多くのテストを実施することではない」と語った。

Tesla Motors(テスラモーターズ)などの自動車メーカーは、「高度に自動化された自動車は、人間が運転するよりも安全だ」と早くから主張している。Koopman氏はこれに対し、「自動車エンジニアには一度振り返って全体像を見据え、公共の安全をより厳しく追求してほしい」と述べた。

膨大なテストが安全性の実証につながるわけではない

Koopman氏が「より多くのテストを実施することが、必ずしも安全性の実証につながるわけではない」と考えるにはいくつかの理由がある。

「まず、テストの数を増やすことは、メーカーが自身を苦しい立場に追い込むことにもなる。自動車の安全規格では、死亡事故が100万時間に1回しか起こらないことが求められると仮定しよう。エンジニアが数百万時間に及ぶ公正なテストを行う中で、事故が1度発生したとする。だが、事故が発生すれば、a)それまでは運がよかっただけなのか、b)テスト中の自動車が目標とする平均事故率をクリアしている中で、通常の統計変動が実際に反映されたのか、を見極めるためには、さらなるテストが必要になる」とKoopman氏は説明している。

Googleはこうした理由から、ロードテストに加えて、数十億時間にも及ぶシミュレーションを実施していると思われる。Koopman氏は、「では、シミュレーションが現実のテストと同様に有効だと仮定してみよう。数十億時間にも及ぶテストの中で、ほんの数回の事故が発生すれば、さらに多くのテストを実施しなければならない。自動運転車が人間が運転するのと同じくらい安全であることを統計的に証明するために、テストの回数は3〜10倍に膨れ上がる可能性もある」と指摘する。

ISO 26262では機械学習を取り扱えない

Koopman氏は「テストをどれほど行ったところで、本当に証明すべきことを証明しているとはいえない。だからこそISO 26262のような規格を使うのだ。同規格はソフトウェアのバグを見つけ出すわけではないが、きちんとしたプロセスに基づいて作られている、という品質の確認はできる」と述べる。ただし、最も頭の痛い問題は、多くの専門家が自動運転の鍵と考えている機械学習は、ISO 26262では取り扱えないという点だ。

自動運転車を開発する上で、研究者たちは、自動車に物体を認識させる方法としてニューラルネットワークに頼ってきた。研究者は、例えば「ネコとイヌの見た目がどう違うのか」を説明する“要件”を記述するわけではない。代わりに、膨大な量のネコやイヌの写真をマシンに見せて、ネコとイヌがどう違うのかを学習させるのである。

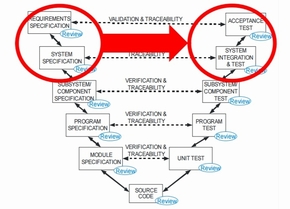

Koopman氏は「要件がなくては、Vモデルを使えない」と指摘する。ISO 26262のエンジニアリングプロセスはVモデルになっている。だが機械学習では記述できる要件がない。つまり認証することができないということだ。

では、高度に自動化された自動車の安全性はどのように認証すればよいのだろうか。

(後編に続く)

【翻訳:滝本麻貴、田中留美、編集:EE Times Japan】

関連記事

我々が求めるAIとは、碁を打ち、猫の写真を探すものではない

我々が求めるAIとは、碁を打ち、猫の写真を探すものではない

ちまたには「人工知能」という言葉が氾濫しています。ですが、明言しましょう。「人工知能」という技術は存在しません。そして、私たちがイメージする通りの「人工知能」の実現も、恐らくはまだまだ先になるでしょう。 ルネサス 自動運転車の頭脳となる次世代SoC発表

ルネサス 自動運転車の頭脳となる次世代SoC発表

ルネサス エレクトロニクスは2015年12月2日、車載情報システム向けSoC「R-Carシリーズ」の第3世代品を発表した。2018年以降に市販される自動車への搭載を見込んだ製品群。第1弾製品として同日、サンプル出荷を開始した「R-Car H3」は“自動運転時代のSoC”と位置付けたハイエンド品で、最先端となるTSMCの16nm世代FinFET+プロセスを採用し、高性能な処理能力を盛り込んだ。 Intel方針転換の真意を探る

Intel方針転換の真意を探る

2016年、Intelはモバイル事業からの撤退を決めるなど方針転換を行った。そうした方針転換の真の狙いを、Thunderbolt用チップ、そして、7年前のTSMCとの戦略的提携から読み取ってみたい。 GFの7nm FinFETプロセス、2018年にも製造開始へ

GFの7nm FinFETプロセス、2018年にも製造開始へ

GLOBALFOUNDRIES(GF)が、7nm FinFETプロセスの開発計画を発表した。2018年後半には同プロセスでの製造を開始する予定だという。さらに、同じく2018年には、22nm FD-SOI(完全空乏型シリコン・オン・インシュレーター)プロセスで製造するチップにおいて、ギガビット未満の低容量の混載MRAM(磁気抵抗メモリ)をサポートする予定だ。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「Renesas 365」がついに始動 「不可能だった規模」の検証、数分で

- NVIDIAとメモリ3社、世界半導体売上高の42%占める

- デンソー、ロームに対する株式取得提案を正式表明

- Armが半導体の自社開発に参入、AIデータセンター向けCPU発表

- イラン戦争の長期化が半導体業界に及ぼす深刻な影響

- もはや半導体メーカーの域を超えた NVIDIA最新エッジ機器を分解

- キオクシアがNanyaに774億円出資、DRAM長期供給契約を締結

- 魚津はTower、砺波はNuvotonに TPSCo事業の再編を発表

- 東芝との協議やデンソー提案への対応、ロームが新声明

- 高NA EUVを「産業規模へ拡張」、imecがEXE:5200導入

米カーネギーメロン大学のPhilip Koopman教授

米カーネギーメロン大学のPhilip Koopman教授