垂直統合にシフトして利益を生み出すApple:半導体を自社製品に“横展開”(2/2 ページ)

「A11」で自社開発GPUとNeural Engineを追加

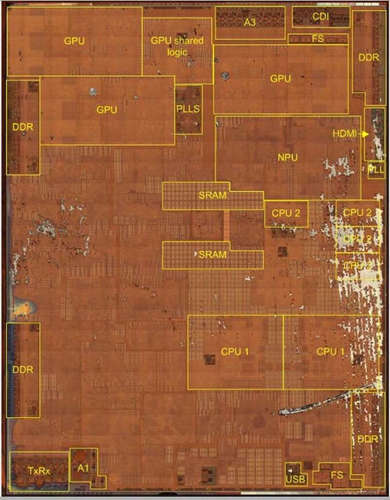

2017年の「A11」に話を進めよう。下の写真は、そのSoCのダイである。A11は、Appleにとって初となる自社開発GPUと「Neural Engine」を搭載しており、いずれも設計の重要な一部を担っている。Appleは、「iPhone X」のプレスリリースの中で、マシンラーニング機能でも、この2つを採用していることを明らかにした。特に、顔認識機能「FaceID」とAnimoji(アニ文字)は、Neural Engineによって動作可能になるという。

ここで重要なのは、iPhoneの性能およびユーザーエクスペリエンスの中核を成す、GPUとNeural Engineの2つのSoCブロックが、追加で搭載されているという点だ。いずれのブロックも、マシンラーニングに貢献することから、将来的に重要性が高まっていくとみられる。

Appleが設計能力を高めていることを示す証拠は、数多く存在する。Jobs氏が、A4を発表した当時に期待していたように、他のスマートフォンに対するiPhoneの差別化要素は、こうした設計力なのだろうか。

例として、FaceIDを取り上げてみたい。Appleは、顔認識などの特徴的な機能を、興味深いものとして捉えているようだ。顔認識技術の周辺にIP(Intellectual Property)を実装すべく、企業の買収なども検討している可能性もある。一部の技術はソフトウェアに、その他の技術はハードウェアに実装されることになるだろう。

Appleは長年にわたり、さまざまな基調講演の中で、ソフトウェア/ハードウェアエンジニアの協調関係を重視してきた。

チーム間のミーティングではたいていの場合、以下のような会話を耳にするだろう。

「AとBのルーチンを実行することができるハードウェアが必要だ」

「そのほとんどを提供できるが、このブロックでこうした動作ができるよう、ルーチンを修正してもらえないだろうか」

こうしたやりとりは、ハードウェアとソフトウェアの統合と構築が実現するまで続く。このようなプロセスを経て設計された回路ブロックは、恐らくAppleだけにしか役に立たないものになるだろう。しかし、それで構わないのだ。

Appleは、自社設計した半導体を着々と、他のApple製品にも適用し始めている。「Apple Watch」の「Sシリーズ」、「AirPods」の「Wシリーズ」、そして「MacOS」端末の「Tシリーズ」といった具合だ。

Appleは着実に半導体設計の能力を上げ、興味深いIPを構築し続けている。半導体の設計リソースを垂直統合的に使用することは、Appleのエコシステムに多大な利益をもたらす。Appleの半導体設計者たちは、「世界一」になる必要はない。Appleの顧客にとってのみ、「一番」になればいいのである。

【翻訳:滝本麻貴、田中留美、編集:EE Times Japan】

関連記事

AppleとIntelの蜜月はいつまで続く?

AppleとIntelの蜜月はいつまで続く?

Steve Jobs氏の時代から始まったAppleとIntelの良好なパートナーシップ。両社ともPCからモバイル分野へと事業を広げる中、AppleとIntelは現在はどのような関係性なのだろうか。 iPhone 8 Plusの心臓部「A11 Bionic」の中身

iPhone 8 Plusの心臓部「A11 Bionic」の中身

TechInsightsが、Appleの「iPhone 8 Plus」を分解し、搭載されたSoC(System on Chip)「A11 Bionic」の写真を公開した。 わずか0.1mm単位の攻防が生んだiPhone X

わずか0.1mm単位の攻防が生んだiPhone X

Appleが、「iPhone」誕生10周年を記念して発売した「iPhone X」。分解すると、半導体技術のすさまじい進化と、わずか0.1mmオーダーで設計の“せめぎ合い”があったことが伺える。まさに、モバイル機器がけん引した“半導体の10年の進化”を体現するようなスマートフォンだったのだ――。 「A9」に秘められたAppleの狙い(前編)

「A9」に秘められたAppleの狙い(前編)

「iPhone」向けのプロセッサはかつて、「Appleは、他社の市販のプロセッサに切り替えるべき」だといわれたこともあった。だが今、「Aシリーズ」の性能は一定の評価を得ている。 Appleのプロセッサ「Aシリーズ」の系譜

Appleのプロセッサ「Aシリーズ」の系譜

Appleは、2013年中にも「iPhone 5S」と第5世代の「iPad」を発売するとみられている。これらには、プロセッサ「A7」「A7X」が搭載されるという見方がある。ここでは、これまでのiPhone/iPadに搭載されてきたプロセッサが、どんな進化を遂げてきたのかを振り返る。 iPhone 5を分解、新型プロセッサ「A6」の謎に迫る

iPhone 5を分解、新型プロセッサ「A6」の謎に迫る

Appleの最新スマートフォン「iPhone 5」を分解し、主要部品のサプライヤーを調査するとともに、新型プロセッサ「A6」にも迫った。A6の全貌はまだ明らかになっておらず、いくつかの謎が残されている。CPUコアの種別と数は? どこで製造されているのか? まだ解析初期の段階だが、チップの刻印を見る限り、ファウンドリは引き続きSamsungのようだ。A6のダイ写真も公開する。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- 村田製作所、25年度は売上高が過去最高 データセンター向けは70%増