限られた画像で学習可能に、希少疾患のAI診断に期待:NVIDIAが新しい手法を開発

NVIDIAのAI(人工知能)研究チームは機械学習分野の最高峰の国際会議である「NeurIPS(Neural Information Processing Systems)2020」(2020年12月6〜12日にオンライン開催)で、1500枚の画像でトレーニングした敵対的生成ネットワーク(GAN:Generative Adversarial Network)を使用して、高品質な合成画像を作成する新たな手法を発表した。

わずか1500枚の学習用画像から生成

NVIDIAのAI(人工知能)研究チームは機械学習分野の最高峰の国際会議である「NeurIPS(Neural Information Processing Systems)2020」(2020年12月6〜12日にオンライン開催)で、1500枚の画像でトレーニングした敵対的生成ネットワーク(GAN:Generative Adversarial Network)を使用して、高品質な合成画像を作成する新たな手法を発表した。

通常、高品質なGANをトレーニングするには5万〜10万枚の学習用画像が必要になる。だが、NVIDIAのチームは、米国のメトロポリタン美術館が所蔵する芸術作品の中から、わずか1500枚の肖像画のデータセットを使って、これらの作品を模倣した新しい画像を作成した。なお、使用したGANは、NVIDIAの「StyleGAN2」である。

今回発表した手法は、希少作品の画風の再現や、歴史的な肖像画に触発された新しい芸術の創作に活用することも可能だが、医療用イメージングAIにとってより大きな意味がある。

医療用AIモデルが直面している重要な問題は、プライバシーに関する懸念から利用可能なトレーニングデータが不足していることだ。特に希少疾患の場合、利用できる画像が10万枚に満たないこともある。NVIDIAの技術を使用すれば、数少ない実画像を基に、希少疾患の合成医療スキャン画像を生成することができる。さらに、この合成データを、その病気を検出するAIモデルのトレーニング用データセットとして利用することも可能だ。

医療分野以外でも、画像形式で大量のAIトレーニングデータを取得することが難しい場合やデータが存在しない場合に生じる問題にも、同様の手法を適用できる。NVIDIAは、この新しい技術によって、トレーニングデータが不足している分野のAI研究が加速することを期待している。

GANは2014年に開発され、AIを活用して合成画像を作成する一つの手段となっている。敵対的生成ネットワークという名が示す通り、互いに相反した動作をする2つのネットワークで構成されている。生成ネットワーク(ジェネレーター)はトレーニングデータを基に合成画像を生成し、識別ネットワーク(ディスクリミネーター)は生成ネットワークが生成した画像を見て、それが本物か偽物かを推測する。

この推測は、識別ネットワークがトレーニングデータセットの画像と生成ネットワークが生成した合成画像の違いを見分けられなくなるまで、繰り返し、識別ネットワークにピクセルごとにフィードバックされる。この技術は、AIディープフェイクの生成といった問題を助長することも懸念されるが、幅広い分野に適用できると期待されている。

GANの問題点は、高品質な結果を生成するためにトレーニング画像の膨大なデータセット(多くの場合、5万〜10万枚の画像)が必要になることだ。ペットの新しい写真を作成したい場合には問題はない。インターネットには猫の写真があふれているからだ。だが、ソース画像が限られているアプリケーションでは、GANを使用するのは難しい。学習用のデータセットに含まれる画像が少なすぎると、識別ネットワークは、それらの画像を記憶するだけとなり、全ての合成画像を偽物(フェイク)として拒否する「オーバーフィッティング」という現象を起こす。これにより、生成ネットワークに有益なフィードバックを送ることができなくなってしまう。

画像の反転や回転などで、データ量を増やす

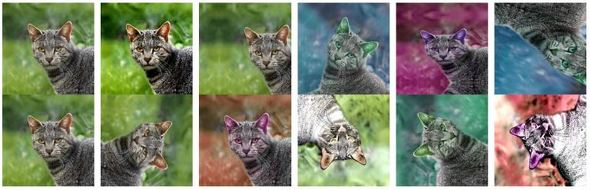

NVIDIAのチームが開発した技術は「ADA(Adaptive Discriminator Augmentation)」と呼ばれる手法で、適応的にデータ拡張を適用する。学習プロセスの異なるポイントで、データ拡張の量を調整するのだ。このアイデアは、コンピュータビジョンで使用された方法に基づいていて、ソース画像の全体あるいは一部に、ランダムな変換やひずみを適用する。これにより、元の画像を反転したもの、回転したもの、色付けしたもの、ゆがめたものといった大規模なデータセットが短時間で生成され、これらをGANの学習に使用することができる。

NVIDIAによれば、このADA手法によって、GANの学習用の画像の数を従来の10分の1から20分の1に減らせるという。

NVIDIAのグラフィックスリサーチ担当バイスプレジデントを務めるDavid Luebke氏は、「画像にノイズを加えたり、ブロックを切り抜いたり、スライドさせたり、色を変えたり、反転したりといったことができる」と説明する。「『Photoshop』でできることの“集合体”と考えてもらえれば分かりやすいかと思う。こうすることで、GANが学習するのに十分な量までソース画像を増やせることになる」(同氏)

【翻訳:青山麻由子、編集:EE Times Japan】

関連記事

NVIDIA CEO「買収完了に自信」、業界は懸念

NVIDIA CEO「買収完了に自信」、業界は懸念

数週間にわたってうわさされていたNVIDIAによるArmの買収が、ついに正式な合意に至った。NVIDIAは、400億米ドル(約4.2兆円)の株式と現金でArmを買収する。NVIDIAの創業者でCEO(最高経営責任者)を務めるJensen Huang氏とArmのCEOであるSimon Segars氏は、2020年9月14日(米国時間)に報道関係者とアナリストを対象に開催した電話説明会で今回の買収について説明し、Huang氏がこの機会に心血を注いでいることが分かった。 NVIDIAがデータセンター売上高で過去最高に

NVIDIAがデータセンター売上高で過去最高に

NVIDIAは2020年8月、2021会計年度第2四半期(2020年4〜6月)の業績発表を行い、データセンター部門の売上高が過去最高を記録したことを明らかにした。Financial Timesは、NVIDIAを新しい“半導体チップの王”として称賛している。 2020年の製品のシリコンは“ほぼ自前”、Appleの開発力

2020年の製品のシリコンは“ほぼ自前”、Appleの開発力

2020年は大型商品の発売が相次いだ。特にApple製品は、“自前のシリコン”搭載が目立ち、Appleの開発力を表すものとなっている。 COVID-19対策貢献も、NVIDIAがヘルスケアAIを加速

COVID-19対策貢献も、NVIDIAがヘルスケアAIを加速

NVIDIAの日本法人エヌビディアは2020年11月24日、「ヘルスケアAIの社会実装を加速させるNVIDIA Clara」プレスブリーフィングをオンラインで開催。同社のAIを活用したヘルスケアプラットフォーム「NVIDIA Clara」の概要や共同研究の概要などについて説明した。 Hyundai、IVIにNVIDIAプラットフォームを採用

Hyundai、IVIにNVIDIAプラットフォームを採用

韓国の自動車大手Hyundai Motor Group(現代自動車、以下Hyundai)は2020年11月9日(韓国時間)、Hyundai、Genesis、Kiaの全モデルの車載インフォテインメント(IVI:In-Vehicle Infotainment)システムにNVIDIAのプラットフォーム「DRIVE」を採用する計画を発表した。 Intelのファブレス化を見据えている? 半導体に巨額助成する米国の本当の狙い

Intelのファブレス化を見据えている? 半導体に巨額助成する米国の本当の狙い

米国の連邦議会が半導体産業に対して大規模な補助金を投じる検討に入ったもようだ。こうした動きには、米国の政府および、半導体業界の強い思惑が見え隠れする。正式な発表は何もないが、ここでは筆者の勝手な推測を並べ立ててみたい。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- キオクシア25年度 驚異の決算 Q4純利益は前年比30倍

- iPhone好調で過去最高も、「世界一」維持へ動くソニー半導体

- 加賀電子が新光商事にTOB、完全子会社化へ

- SiC LSIの事業化に挑む 28年以降ADCのサンプル出荷へ

- Cerebrasが上場 NVIDIA対抗馬の「試金石」となるか

- ソニーセミコンCTOに聞く――イメージセンサー技術革新の核

- AIの「トンデモ判断」で本番DBが全飛び! 他山の石にしたいAIコーディングの落とし穴

- サンケン電気26年3月期は赤字転落 中国の「自前主義」響く

- JDI、25年度Q4は4年ぶり黒字 上場廃止は「必ず阻止」

- 「技術ナンバーワンであり続ける」 ソニーセミコンCTOが語る技術戦略