自動運転ではカメラを重視、CESでIntelが基調講演:専門家は「現実的だ」と評価

「CES 2018」の基調講演に登壇したIntelは、自動運転車向け開発プラットフォームを紹介した。競合陣営がレーダーやライダーなどを活用するAI(人工知能)ベースのセンサーフュージョンに注力するのに対し、Intelは“カメラ”の活用を最優先する考えだ。

MobileyeとIntelのCEOが共に登壇

IntelのCEO(最高経営責任者)を務めるBrian Krzanich氏は2018年1月8日(現地時間)の夜、「CES 2018」(2018年1月9〜12日、米国ネバダ州ラスベガス)に登壇し、同社の自動運転車向けプラットフォームを紹介した。同氏のスピーチは、CES 2018で最も期待されていた。

Intelが買収したMobileyeは2017年の夏に、レベル4(L4)の自動運転車を100台以上製造する計画を発表していたが、今回初めて、MobileyeのCEOがKrzanich氏と共に登壇した。

この基調講演は、Intelがいつものように、自動運転向けプロセッサの優れた処理性能(TOPS:Tera Operations Per Second)と消費電力(ワット)などを誇示すると予想していた参加者にとっては、意外な内容だった。

Intelは、“カメラファースト”の自動運転車戦略を進めているという。具体的には、活用が進んでいるカメラベースのADAS(先進運転支援システム)を用いて、自動運転の安全な走行に役立つ“ロードブック(走行経路、区間距離などが記載されている冊子)”を構築する計画だ。ここで重要なのは、Intelが「自動運転の開発には、複雑なセンサーフュージョンやブルートフォースプロセッシングが重要だ」とは主張していないことだ。

Intelの戦略から、自動運転車業界の実態が見て取れる。自動運転車業界はまだ未成熟ではあるが、既に2つの派閥に分かれている。IntelおよびMobileye陣営は、競合に比べるとより長期的な進化の道を歩み始めている。一方でWaymoやUberTechnologiesは、できる限り迅速に自社の自動運転車を開発して配車サービスやロボタクシー事業への参入を急いでいるように感じる。

VSI Labsの創設者でプリンシパルを務めるPhil Milagney氏は、「自動化機能が段階的に進化していくと考えれば、Intelのアプローチは非常に現実的だ」と評している。

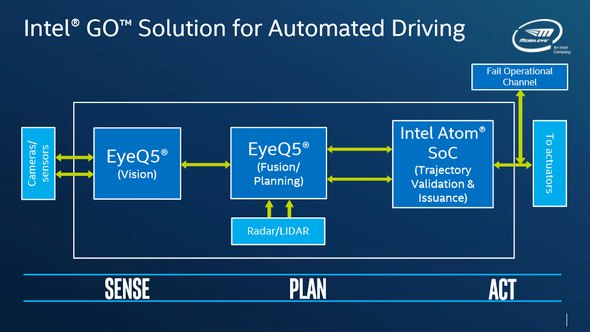

基調講演の中で発表されたIntelの自動運転車向け開発プラットフォーム「Intel GO」は、2018年に発売予定だという。“ビジョンファースト”の哲学を中核に組み込んだ同プラットフォームは、驚くほどシンプルだ。Mobileyeの2つの「EyeQ5」チップ(1つはビジョン処理用で、もう1つはセンサーフュージョンおよびプランニング用)、IntelのSoC(System on Chip)「Atom」で構成される。FPGAやニューラルネットワークプロセッサ「Intel Nervana platform」、その他の驚くようなAI(人工知能)チップは一切搭載されていない。

Intelの対抗陣営は、対象物の検知にLiDAR(ライダー)やレーダーなどさまざまなセンサーを活用する。これに対し、Intelは、「カメラは、自動運転車が走行路の地形やその他の静的な状況に確実に対応できる唯一のリアルタイムセンサーだ。カメラは、最も低いコストで最高の性能データを自動運転車に提供できる」と主張している。

Intelの“ビジョンファースト”アプローチに対し、Waymoの自動運転車は、位置情報の特定をHDカメラ、レーダー、ライダーによるAIベースの高性能センサーフュージョンで行っている。

米国の市場調査会社であるStrategy Analyticsで車載接続モビリティ部門のディレクターを務めるRoger Lanctot氏は、「Intelは、距離計算にカメラ、レーダー、低解像度のライダーを利用して自動運転を進化させる道を選んだ」と述べている。

【翻訳:滝本麻貴、編集:EE Times Japan】

関連記事

2017年半導体メーカーランキング(速報版)

2017年半導体メーカーランキング(速報版)

米調査会社のGartner(ガートナー)は2018年1月4日、2017年の半導体メーカー別売上高ランキング(上位10社)を発表した。 Intelが10nmプロセスの詳細を明らかに

Intelが10nmプロセスの詳細を明らかに

Intelは2017年に10nmチップ製造を開始する予定だ。さらに、22nmの低電力FinFET(FinFET low power、以下22nm FFL)プロセスも発表した。GLOBALFOUNDRIESなどが手掛けるFD-SOI(完全空乏型シリコン・オン・インシュレーター)に真っ向から挑み、ファウンドリービジネスで競い合う。 Intelの高性能・高密度パッケージング技術「EMIB」の概要

Intelの高性能・高密度パッケージング技術「EMIB」の概要

今回は、Intelが開発した2.nD(2.n次元)のパッケージング技術「EMIB(Embedded Multi-die Interconnect Bridge)」を解説する。EMIBではシリコンインターポーザの代わりに「シリコンブリッジ」を使う。その利点とは何だろうか。 Intel、3Dメモリの生産拡大に向け設備投資を増加

Intel、3Dメモリの生産拡大に向け設備投資を増加

Intelが、3D(3次元) NAND型フラッシュメモリや「3D XPoint」メモリの生産拡大に向け、設備投資を増加する。Intelの不揮発メモリソリューショングループは、最も規模が小さい事業部門でありながら、売上高では高い成長率を記録している。 IntelとMobileyeの独占状態、吉か凶か

IntelとMobileyeの独占状態、吉か凶か

IntelによるMobileyeの買収発表は、業界にさまざまな反応を引き起こした。専門家の見解は両極端だが、この2社によって自動運転車市場が独占されるのではないか、そしてそれは、健全な競争を妨げるのではないかという懸念は確実に存在する。 2018年の世界8大技術トレンド、IHSが予測

2018年の世界8大技術トレンド、IHSが予測

IoT(モノのインターネット)、クラウド、人工知能(AI)――。産業界を一変させる可能性が高い技術とは何か。IHS Markitが2018年の世界8大テクノロジートレンドを予測した。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- ソニー半導体、26年度は減収見込み メモリ市況不透明

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼