教師データなしで声を聞き分ける脳型学習アルゴリズム:脳型計算チップに実装

理化学研究所(理研)は、教師データがなくても、ノイズが混じった信号源から特定の人の声を聞き分けることができる「脳型学習アルゴリズム」を開発した。

脳型計算チップに実装、高速・低消費電力処理が可能に

理化学研究所(理研)脳科学総合研究センター神経適応理論研究チームの磯村拓哉基礎科学特別研究員と豊泉太郎チームリーダーは2018年2月、教師データがなくても、ノイズなどが混じった信号源から特定の人の声を聞き分けることができる「脳型学習アルゴリズム」を開発したと発表した。

開発した脳型学習アルゴリズム「EGHR-β(Error-Gated Hebbian Rule β)」は、並列計算でノイズ除去と信号分離を同時に実行することができる。これによって、出力の模範となるべき教師データがなくても、必要な信号を抽出(出力)することができるという。

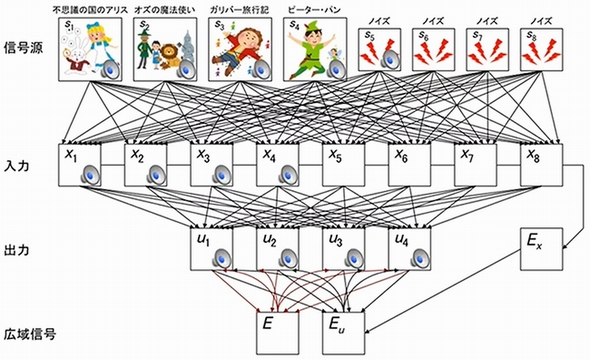

その一例として、街中に設置された複数個のマイクで収集した音源から、主要な音源を抽出する事例を挙げた。取得した音声データには、ノイズも含め異なる重みで多くの信号が重畳されている。EGHR-βは、これらの混合データをニューラルネットワークへの入力と考え、信号の分布を手掛かりに主要な音源を抽出する。この時、脳で起こるシナプスの学習をヒントに、広域信号を用いて学習を調節するという。

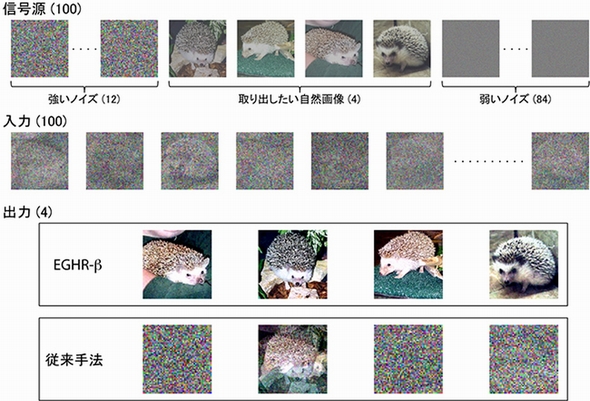

EGHR-βが効率よく信号源を抽出できる理由は、ノイズ除去と信号分離を同時に行うことができるためだ。強いノイズが重畳した合成画像でもEGHR-βを適用すれば、信号源の自然画像を復元することができるという。従来手法だと自然画像の情報もノイズと一緒に除去してしまい、適切に復元することが難しかった。

研究グループは、「将来は脳型計算チップに実装し、高速かつ低電力で信号の抽出が可能になる。EGHR-βは、脳で起こるシナプスの学習と類似した性質を持ち、脳の学習メカニズムを理解することにも役立つ」とみている。

関連記事

シリコン量子ドット構造で高精度量子ビット実現

シリコン量子ドット構造で高精度量子ビット実現

理化学研究所らの研究グループは、シリコン量子ドット構造で世界最高レベルの演算精度を実現した電子スピン量子ビット素子を開発した。シリコン量子コンピュータの開発に弾みをつける。 東京大学ら、「ワイル磁性体」を初めて発見

東京大学ら、「ワイル磁性体」を初めて発見

東京大学物性研究所の黒田健太助教らによる研究グループは、反強磁性体マンガン化合物の内部で、「磁気ワイル粒子」を世界で初めて発見した。 洗濯可能な薄型有機太陽電池、理研らが開発

洗濯可能な薄型有機太陽電池、理研らが開発

洗濯が可能な超薄型有機太陽電池を理化学研究所(理研)の福田憲二郎研究員らが開発した。伸縮性と耐水性にも優れており、衣服貼り付け型電源として利用することが可能となる。 反強磁性体で巨大な異常ネルンスト効果を発見

反強磁性体で巨大な異常ネルンスト効果を発見

東京大学らの研究グループは、反強磁性体マンガン合金で、自発的な巨大熱起電力効果が現れることを発見した。素子構造が比較的単純で、集積化により高出力を実現することも可能となる。 伸縮性導体、5倍に伸ばしても高い導電率を実現

伸縮性導体、5倍に伸ばしても高い導電率を実現

東京大学の松久直司博士と染谷隆夫教授を中心とした研究チームは、長さを元の5倍に伸ばしても導電率が935S/cmという世界最高レベルを示す伸縮性導体の開発に成功した。 理研、東芝とNEC、富士通の3社とAI研究で連携へ

理研、東芝とNEC、富士通の3社とAI研究で連携へ

理化学研究所(理研)は2017年3月10日、東芝、NEC、富士通の各社と、理研革新知能統合研究センター内に連携センターを開設する。設置期間は、2017年4月1日から2022年3月31日までの予定だ。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 村田製作所、25年度は売上高が過去最高 データセンター向けは70%増