Intelは「データの移動・保存・処理」で貢献:データセンターの革新に向け(2/2 ページ)

「データの保存」では「Optane」に期待

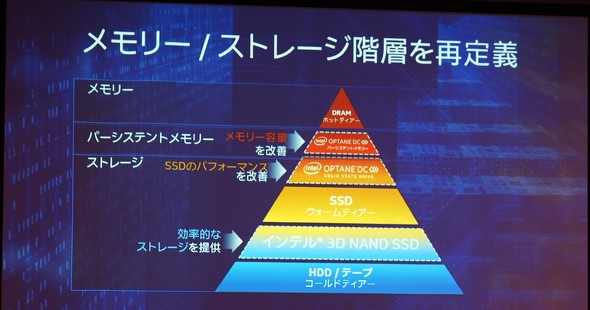

「データの保存」については、HDDとDRAMの間を埋めるメモリ/ストレージ階層を示した。まずは、4ビット/セルのQLC(Quad Level Cell)方式を導入した3D(3次元) NAND型フラッシュメモリを用いたSSDがある。これにより、今まではHDDしか搭載していなかったアプリケーションでSSDを使えるようになると土岐氏は説明する。「特に、2017年あたりから見られる傾向として、組み込み系の顧客が、HDDからSSDへの関心が高まっている」(土岐氏)

SSDの上のレイヤーには、「3D XPoint」技術をベースに開発した不揮発性メモリ技術「Optane」を採用したSSD「Optane DC(Data Center) SSD」が、さらにその上、DRAMの一歩手前として「Optane DC パーシステント・メモリー」がある。DRAMと同様にメインメモリとしても使用できるものだ。土岐氏は、「保存をより多く、という考え方もあるのだが、データをいかに効率よくプロセッサに渡すか、という点をIntelは重視し、メモリも含めてさまざまな技術開発に取り組んでいる」と述べた。

AI向けに最適化したXeon スケーラブルプロセッサ

「データの処理」については、「Intel Xeon スケーラブルプロセッサ」が2018年に1周年を迎えたと言及。これまでのXeonプロセッサに比べると、最速で100万個の出荷を達成したという。

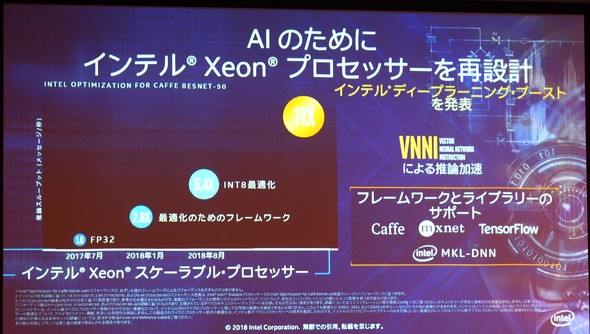

Xeon スケーラブルプロセッサは、AIへの適用を最大限に意識して再設計したものだと土岐氏は述べる。特長の一つとして、推論を加速する「インテル ディープラーニング ブースト」に対応している。このインテル ディープラーニング ブーストは幾つかのテクノロジーを組み合わせたもので、Cascade Lakeに搭載されるものは、VNNI(Vector Neural Network Instruction)という命令セットを含んでいる。これにより、既存のXeon スケーラブルプロセッサに比べ、最大11倍まで推論性能が向上するという。

VNNIを含んだ「インテル ディープラーニング ブースト」により、推論性能が最大11倍まで向上するという(写真では見えにくいが、左側のグラフ中の黄色い丸の中に「11X」(=11倍)と書かれている) (クリックで拡大)

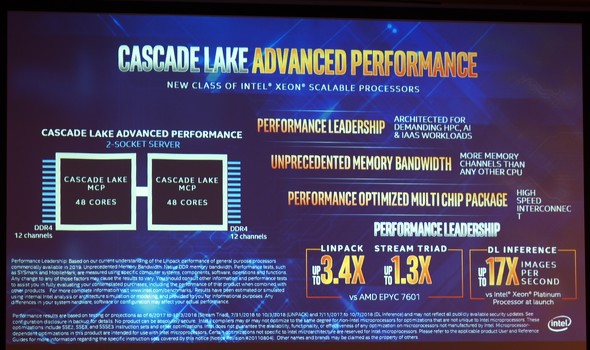

VNNIを含んだ「インテル ディープラーニング ブースト」により、推論性能が最大11倍まで向上するという(写真では見えにくいが、左側のグラフ中の黄色い丸の中に「11X」(=11倍)と書かれている) (クリックで拡大)さらにIntelは2018年11月、新しいXeon スケーラブルプロセッサとして「Cascade Lake-AP(Advanced Performance)」を発表。最大48個のコアを搭載し、12個のDDR4メモリチャンネルをサポートする。2019年前半に市場に投入する予定だ。性能はAMDの「EPYC 7601」と比較して、LINPACKで最大3.4倍、Stream Triadで最大1.3倍、そして、「Xeon Platinum」に比較して、ディープラーニングの推論性能が最大17倍向上するとしている。

土岐氏は、Intelが2018年12月に発表したばかりの3D積層チップ技術「Foveros」についても言及。同氏は、「これまで3D積層技術は、スマートフォン向けのメモリに適用されることが多かった。Foverosの最大の特長は、メモリだけでなく、高速に動作する必要があるロジックも積層していく点だ。積層することで、異なるプロセスを用いたシリコンを一つのモジュールに入れることができる。最適なプロセスで製造したシリコンを組み合わせることで、高性能なチップを作れる技術として期待している」と語った(関連記事:「Intelが新しい3D積層チップ技術「Foveros」を発表」)。

CPU不足は2019年にも解消

Intelは十分なCPU供給量を確保できずCPU不足を招いているが、それについて鈴木氏は「改善を進めている。設備投資として、年初の計画から10億米ドルの追加投資を決定し、トータルで150億米ドルを投資する。これは過去最大の規模だ。大半は米国オレゴン州とアリゾナ州、アイルランドおよびイスラエルの14nmプロセスの製造拠点に投入される。2019年には、CPU不足が解消される見込みだ」と述べた。

関連記事

Intel 10nmプロセスの遅れが引き起こしたメモリ不況

Intel 10nmプロセスの遅れが引き起こしたメモリ不況

2018年、メモリ市場の成長に暗雲が立ち込め、メモリ不況が避けられない事態となった。アナリストらは、メモリの過剰供給による価格の下落を要因として指摘しているが、どうも腑に落ちない。そこで筆者は、Intelの10nmプロセスの遅れという点から、メモリ不況の要因を探ることにした。 2018年半導体売上高1位はSamsungか、Intelとの差が開く

2018年半導体売上高1位はSamsungか、Intelとの差が開く

2018年の半導体売上高ランキングでは、Samsung ElectronicsがIntelとの差をさらに広げ、2017年に続き首位に立つ見込みだという。市場調査会社のIC Insightsが発表した。 Intelの創業4年目(前編)、半導体メモリのトップベンダーに成長

Intelの創業4年目(前編)、半導体メモリのトップベンダーに成長

Intelの創業4年目(1971年)は、「飛躍の年」となった。不揮発性メモリとマイクロプロセッサという、2つの画期的な製品を開発したのだ。前編では、この2製品と、本社社屋の移転について紹介する。 Intelの高性能・高密度パッケージング技術「EMIB」の概要

Intelの高性能・高密度パッケージング技術「EMIB」の概要

今回は、Intelが開発した2.nD(2.n次元)のパッケージング技術「EMIB(Embedded Multi-die Interconnect Bridge)」を解説する。EMIBではシリコンインターポーザの代わりに「シリコンブリッジ」を使う。その利点とは何だろうか。 Intel、イスラエルの10nm工場に50億米ドルを投入へ

Intel、イスラエルの10nm工場に50億米ドルを投入へ

Intelは、今後2年間で50億米ドルを投じ、イスラエルのキルヤット・ガト(Kiryat Gat)にある同社工場のプロセス技術を、既存の22nmから10nmへとアップグレードする予定だという。 “お蔵入りチップ”が掘り出し物に? Intel FPGAが示す過去の半導体の価値

“お蔵入りチップ”が掘り出し物に? Intel FPGAが示す過去の半導体の価値

Intel FPGAとして発表された「Cyclone 10 LP」。これには、約10年前のプロセスとシリコンが使われている。これは、何を意味しているのだろうか。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- 村田製作所、25年度は売上高が過去最高 データセンター向けは70%増

インテルの土岐英秋氏

インテルの土岐英秋氏