生成AI向け基盤モデルのメモリ使用量を98%削減:枝刈りアルゴリズムを新たに開発

中部大学の研究チームは、生成AIに必要となる「基盤モデル」のメモリ使用量を、従来に比べ98%も削減可能なアルゴリズムを開発した。開発したアルゴリズムを物体認識に適用したところ、従来と同等の性能が得られることを確認した。

再学習によって大きく変化しなかったパラメーターを枝刈り

中部大学の研究チームは2023年7月、生成AIに必要となる「基盤モデル」のメモリ使用量を、従来に比べ98%も削減可能なアルゴリズムを開発したと発表した。開発したアルゴリズムを物体認識に適用したところ、従来と同等の性能が得られることを確認した。今後は半導体メーカーと手を組み、早期実用化を目指す。

生成AI技術は、文書や画像の生成において、その活用が注目されている。こうした中で、自動運転車や工作用ロボットなどに向けた用途では、エッジ端末側でリアルタイム処理を行う必要がある。そこで取り組んだのが、大規模な基盤モデルのメモリ使用量を削減して処理時間を短縮しても、実用レベルの性能が得られるアルゴリズムの開発である。

演算量を減らすアルゴリズムとしてはこれまで、事前学習時に求めたパラメーターの中で、値(重み)が小さいものを「枝刈り」する方法などが考えられていた。これに対し研究チームは、枝刈りをするパラメーターについて、事前学習で得た「重み」で選ぶのでなく、「チューニング(再学習)によって大きく変化する」パラメーターを選ぶことにした。

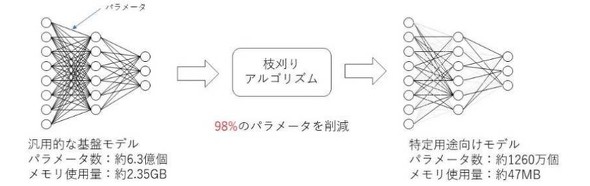

実験の結果によると、再学習で大きく変化しなかったパラメーターを、最大98%枝刈りしても、刈り取る前とほぼ同等の出力が得られることが分かった。約6.3億個のパラメーター数で構成される汎用的な基盤モデルについて、開発したアルゴリズムを用い98%枝刈りした。これにより、特定用途向けモデルのパラメーター数は約1260万個となり、2.35Gバイトだったメモリ使用量を、47Mバイトに削減できたという。これだけ使用量が小さくなれば、特定用途向け組み込みシステムでも、画像生成AIを構築できる可能性があるとみている。

ちなみに、1750億個のパラメーターで構成される文書生成AIの代表的な大規模言語モデルに、今回のアルゴリズムを適用した場合、演算に必要なメモリ容量を約560Gバイトから約11Gバイトに削減できるという。つまり、PC単体で質問の入力から文書の生成まで対応可能になることが分かった。

今回の研究成果は、中部大学工学部情報工学科の山下隆義教授と理工学部AIロボティクス学科の藤吉弘亘教授、AI数理データサイエンスセンターの平川翼講師、大学院工学研究科情報工学専攻の小濱大和大学院生らによるものである。

関連記事

「安全な生成AI」の社会実装に向け本格始動、GUGA

「安全な生成AI」の社会実装に向け本格始動、GUGA

2023年5月に発足した「生成AI活用普及協会(GUGA)」が記者説明会を実施し、同協会の概要や設立背景をあらためて語った。資格試験「生成AIパスポート」やコミュニティーの提供を通じて、生成AIの公正かつ安全な普及/社会実装を目指している。 弱きを助けるよりも強きに頼れ! ―― 実現性の高い日本の半導体・デジタル産業戦略とは

弱きを助けるよりも強きに頼れ! ―― 実現性の高い日本の半導体・デジタル産業戦略とは

経済産業省は2023年6月6日に「半導体・デジタル産業戦略」の改定を取りまとめ公表した。その内容を見ながら、実現性の高い日本の半導体・デジタル産業戦略について考えてみたい。 AMDの新GPUは、NVIDIA H100に比肩しうるか?

AMDの新GPUは、NVIDIA H100に比肩しうるか?

AMDは2023年6月、NVIDIAのフラグシップGPU「H100」に対抗する製品として、生成AI向けの高性能GPU「MI300X」を発表した。「AIは最大かつ最も戦略的な成長機会」とするAMDだが、新製品によって、市場を先行するNVIDIAに迫ることができるだろうか。 時価総額1兆ドル超え、生成AIブームに乗るNVIDIA

時価総額1兆ドル超え、生成AIブームに乗るNVIDIA

生成AIの世界的ブームの波に乗り、NVIDIAの時価総額は1兆ドルを突破した。同社CEO、Jensen Huang氏は2023年5月、「COMPUTEX TAIPEI 2023」の基調講演で登壇し、生成AIの持つ可能性や、その基盤として必要となる最新製品について語った。 ChatGPTは怖くない 〜使い倒してラクをせよ

ChatGPTは怖くない 〜使い倒してラクをせよ

ある日突然登場し、またたく間に世間を席巻した生成AI「ChatGPT」。今や、ネットでその名を聞かない日はないほどです。このChatGPTとは、一体何なのか。既に数百回以上、ChatGPTを使い倒している筆者が、ChatGPTの所感をエンジニア視点で語ってみたいと思います。 大規模言語モデルの未来は「オープンソース化」にある?

大規模言語モデルの未来は「オープンソース化」にある?

大規模言語モデル/生成AI(人工知能技術)への関心が急速に高まる一方、それらの技術のコントロールが、一部の企業にあることを懸念する声も少なくない。業界の専門家たちは、「AIの民主化」に関する問題解決の糸口は、大規模言語モデルのオープンソース化にあると語る。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- ソニー半導体、26年度は減収見込み メモリ市況不透明

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼