NANDを再定義、HBMを補完するAI用メモリ技術「HBF」:SK hynixは26年1Qに試作発表へ(2/2 ページ)

HBFの可能性と商用化までの課題

以下に、HBFはどのような問題を解決できるのか、また商用化を実現する上で今後どのような課題が待ち受けているのかという点について、概要をまとめたい。

HBFは、HBMのようなパッケージに組み込まれたNANDフラッシュメモリ技術だ。主なターゲットに定めているのは、レイテンシに敏感なアプリケーションではなく、読み出し中心のAI推論タスクである。HBFの特性である大容量と高スループットは、特に現在ではハイパースケーラー企業が推論をエッジ向けに推進していることもあり、AIモデルのストレージや推論要件に合致している。

一般的にエッジAI、一般的に事前学習済みモデルを採用していることが多く、HBFのアドバンテージである高速読み出し帯域幅と大容量にうまく合致する。また、HBFの弱点である書き込み速度の遅さや耐性の低さにも影響を受けない。さらに、HBFは消費電力量が低いため、エネルギー制約が厳しいエッジ環境にも最適だ。

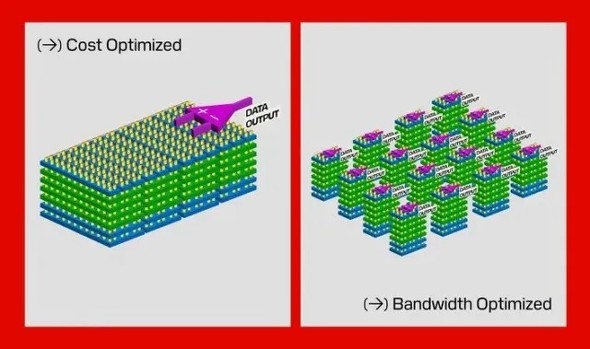

次に、データセンターでは、HBFはトレーニングワークロードの分野でHBMを置き換えるわけではないが、HBM向けの容量拡張として有効に機能し得る。このハイブリッドモデルでは、HBMが高速キャッシュとして機能し、既存の計算に緊急に必要とされる大量データを保持する一方、AIモデルはHBFに保存される。これが、SK hynixが最近発表したハイブリッドメモリアーキテクチャ「H3」の基本的な前提とされている。

HBFは、HBMで補強されることによって、AIアクセラレーターにテラバイト級のメモリを追加する。しかし、HBFが桁外れの容量実現を確約する一方で、桁外れの複雑性にも直面する。特にインターコネクトの部分は、非常に難しい課題になるだろう。書き込み耐性に制約がある上、NANDのブロックレベルのアドレッシング制限といった課題もある。

しかし、懐疑的な見方が強いにもかかわらず、ヘテロジニアススタックで構築されたこのメモリ技術は、AI推論向けとしての優れた適合性から、急速に市場に浸透しつつある。HBFは、1638Gバイト/秒(GB/s)を超える帯域幅を達成する可能性があり、これはSSDと比べると大きな飛躍となる。また、最大512GBを実現すると期待されていて、HBM4の64GBを上回る見込みだ。

Sandiskがこの新しいストレージソリューションを「メモリ中心のAI」と呼ぶのも当然だといえる。

【翻訳:田中留美、編集:EE Times Japan】

関連記事

2026年半導体市場の3大トピックを深掘り ―― DRAM不足の真相とTSMC、Intelの逆襲

2026年半導体市場の3大トピックを深掘り ―― DRAM不足の真相とTSMC、Intelの逆襲

2026年の半導体市場を占う「10の注目トピック」の中でも、特に反響の大きかった3点を徹底深掘りする。 NORフラッシュにもAI需要の波、迫る供給危機

NORフラッシュにもAI需要の波、迫る供給危機

DRAMとNAND型フラッシュメモリの供給不足に続いて、もう1つのメモリ分野であるNORフラッシュメモリでも供給危機が発生しつつあり、値上げの可能性も報じられている。一方でAIアプリケーションがかつてない高密度を要求することから、3D構造化への期待も高まっている。 HBMの代替どころか、勇み足で終わりかねない「HBF」

HBMの代替どころか、勇み足で終わりかねない「HBF」

サンディスクが広帯域フラッシュ「HBF(High Bandwidth Flash)」の開発と戦略を支援する「HBF技術諮問委員会」を設立した。HBFとは何なのか。広帯域メモリ「HBM」の代替をうたうが、うまくいくのだろうか。 HBMと同等コストで記憶容量8倍、サンディスクが「HBF」推進強化

HBMと同等コストで記憶容量8倍、サンディスクが「HBF」推進強化

サンディスクは、広帯域フラッシュ(「HBF」)メモリ技術の開発と戦略を支援する「HBF技術諮問委員会」を設立した。サンディスクがHBFの製品化に取り組む中で、HBFをAI向けメモリのスタンダードにしていくための活動を行う。 CESで繰り広げられたHBM4開発競争 Samsungも巻き返しアピール

CESで繰り広げられたHBM4開発競争 Samsungも巻き返しアピール

「CES 2026」では、メモリ大手3社が手掛ける広帯域メモリ(HBM)の最新技術「HBM4」に注目が集まった。長らくSK hynixに後れを取っていたSamsung Electronicsも巻き返しを図っている。 2026年のHBM市況、カギを握るのは最新世代「HBM4」

2026年のHBM市況、カギを握るのは最新世代「HBM4」

2025年8月に開催された「FMS(the Future of Memory and Storage)」の一般講演を紹介するシリーズ。今回はTrendForceのアナリストであるEllie Wang氏の講演を取り上げる。広帯域メモリ(HBM)の生産能力や容量、価格を予測する。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- ヘリウム調達停止――AIブームを崩壊させる「見えない臨界点」(前編)

- 石炭灰から「レアアース元素」を回収、新日本繊維【訂正あり】

- Rapidus、IIM-1を「世界初の前/後工程一貫工場に」

- ヘリウム調達停止――AIブームを崩壊させる「見えない臨界点」(後編)

- 「27年度後半の2nm量産誓う」 Rapidus、解析センター開設

- EVに吹く逆風 デンソーの焦りとロームが求める勝機とは

- 経産省、Rapidusに6315億円追加支援 「国益のため必ず成功」

- 光電融合チップレットの技術開発を開始 LSTCとimec

- 「技術を束ねて高価値システムに」 デンソーが2030年中計発表

- 京セラ、ウシオ電機の半導体レーザー事業を取得へ