感情とIoTを融合させた新しいサービスモデルの提案:JASA発IoT通信(6)(6/6 ページ)

エモーションドリブンサービスモデルプロトタイプ【2】

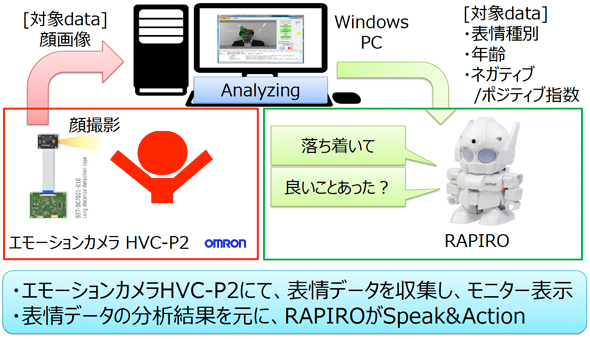

2つ目のプロトタイプは、エモーションカメラを利用し、人の表情(画像)から感情を識別する検証を行った。

ET展でのデモの内容は、エモーションを検知できるカメラを使用し、表情、年齢、ネガティブ/ポジティブ指数をセンシングし、センシングしたデータにより、60パターン以上の音声出力とアクションをRAPIROが実行するというものである。下記に構成図と、実際のプロトタイプの画像を示す。

ET 2017のデモにて、来場者の表情を撮影し認識結果を確認したところ、定性的な評価ではあるが、笑った顔、悲しい顔などの表情による感情の識別精度は高いように思われた。しかしながら、わざと表情を変えて撮影することにより、認識結果を意図的に変えることができたため、人の表情(画像)のみでの感情識別は表面的なものとなる。また、認識した結果により、RAPIROが話し掛けることは、来場者の反応がよかったため、コミュニケーションロボットとの相性がよいことが分かった。

まとめ

感情とIoTを融合させた新しいサービスモデルとしてエモーションドリブンサービスモデルの提案を行った。エモーションドリブンサービスモデルの具体例を考えると、さまざまなサービスモデルが考えられる。エモーションのみをトリガーとしたサービスは、エモーションセンシングが発展途上の技術であるため難しいと考える。しかしながら、エンターテイメント分野などで特定のユースケースに絞り、コンテンツ(サービス)の内容次第では、エモーションドリブンの面白いサービスが生まれる可能性がある。また、既存のサービスにエモーションセンシングの要素を組み合わせることによって、価値の向上が図れる可能性も期待される。

エモーションWGでは、エモーションドリブンサービスユースケースを検討すると共に、多様なエモーションドリブンサービスユースケースに対応できるように、組込み視点でさまざまなエモーションキャッチセンサーの特性を調査し、エモーションドリブンサービスユースケースの可能性の幅を広げていく。そして、エモーションセンサーフュージョンシステムついてさまざまなエモーションキャッチセンサーの組み合わせを検討していく。

関連記事

顔の表情や生体情報から、感情や眠気を推定

顔の表情や生体情報から、感情や眠気を推定

パナソニックは、人間の表情や生体情報から、感情や体調を瞬時に推定できる技術などを「CEATEC JAPAN 2017」で紹介した。 日本は「移動するIoT」をどう考えるべきか? 〜 産業用ドローンへの取り組み

日本は「移動するIoT」をどう考えるべきか? 〜 産業用ドローンへの取り組み

ドローンは、移動しながらインターネットにつながるロボットであり、「移動するIoT」と呼べる。今回は、ドローンを「移動するIoT」と捉えつつ、さまざまな角度から考察していく。 IoTサービスを実現するためのスキルとは?

IoTサービスを実現するためのスキルとは?

今回は、ドローンを用いたゴルフ場でのキャディビジネスを例に挙げながら、IoTを実現するために必要なスキルは、どのようなものかを考えていく。 IoT時代で勝つには“組み込み視点”の議論が必要だ

IoT時代で勝つには“組み込み視点”の議論が必要だ

EE Times Japanでは、組込みシステム技術協会(JASA)とスキルマネージメント協会(SMA)が推進する「IoT技術高度化委員会」とコラボレーションし、連載「JASA発IoT通信」をお届けしていく。連載第1回目は、同委員会で主査を務める竹田彰彦氏のインタビューを紹介する。 “気になる瞬間”を自動で記録、脳波センサーと連動するウェアラブルカメラ

“気になる瞬間”を自動で記録、脳波センサーと連動するウェアラブルカメラ

カメラと脳波センサーを連携し、「気になるもの」「興味があるもの」を自動で撮影する――。脳波を利用したアプリケーションの開発を手掛ける電通サイエンスジャムが、そんなデモを披露した。 笑う人工知能 〜あなたは記事に踊らされている〜

笑う人工知能 〜あなたは記事に踊らされている〜

AI(人工知能)に関する記事は、メディアにあふれ返っています。私は「これらの記事では“人工知能”のことがさっぱり分からん」との結論に至りましたが、では、人工知能を技術的に理解している人は実際どれだけいるのでしょうか。ざっくり推定すると、なんと、例えば「深層学習」を理解している人は50万人のうち4人、という結果を得たのです。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

エモーションカメラを利用し人の表情(画像)から感情を識別する検証デモの構成イメージ

エモーションカメラを利用し人の表情(画像)から感情を識別する検証デモの構成イメージ