“脳型プロセッサ”を統合したイメージセンサー開発へ:SynSenseとProphesee(2/2 ページ)

SynSense、CNNに合わせたデジタルアーキテクチャを開発

SynSenseの低次元信号(音声、生体信号、信号監視)処理用ミックスドシグナルプロセッサの消費電力は500μW未満である。SynSenseは、自社技術をすぐに製品化する計画ではなかった。オンチップのリソースがビジョンプロセシングの要件であるCNNを動作させるには十分ではなかったからだ。同社は、CNNに合わせた2つ目のデジタルアーキテクチャを開発した。そのIPはPropheseeのMetavisionセンサーに統合される予定だという。

完全な非同期デジタルアーキテクチャに移行することは、消費電力を減らしつつ、より高度なプロセス技術に移行できることも意味する。

SynSenseのプロセッサIPは、CNNのイベントベースバージョンに合わせたスパイキング畳み込みコアで構成されている。SynSenseは、スパイキングニューラルネットワーク向けの誤差逆伝搬(バックプロパゲーション)をベースとしたトレーニングを採用している。Muir氏によると、そうしたアプローチによって、イベント領域の中で作動するよう変換された標準的なCNNを超えて時間信号の処理を強化できる。誤差逆伝搬は、トレーニング中にスパイクの微分を近似することで得られる。それとは対照的に、推論は完全にスパイクベースとなる。

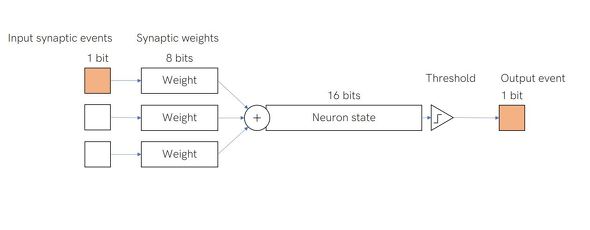

SynSenseのスパイキングニューロンはシナプスの重みは8ビット、ニューロンステートは16ビット、閾値は16ビット、1ビットの入出力のスパイクを持つ整数論理を用いている。このニューロンはシンプルなニューロンモデルである「積分発火」だ(これは「漏れ積分発火」などのより複雑なモデルに比べ最もシンプルなニューロンモデルといえる。よりシンプルなバージョンでは、入力がない場合は内部状態が減衰しないため、計算要件が減る)。SynSenseのニューロンでは8ビットの数値と16ビットの数値を加算し、それを16ビットの閾値と比較する。

Muir氏は「ニューロンの設計をここまで単純化しながら、極めて優れた性能を実現できたことに、当初われわれも少し驚いた」と述べた。

SynSenseのデジタルチップはCNN処理に特化しており、CNNの各レイヤーは異なるプロセッサコアで処理される。コアは単独で非同期的に動作する。全体の処理パイプラインはイベントによって駆動する。(ユーザーがデバイスを見ているかどうかにかかわらず)相互作用の意図を監視するシステムのデモでは、SynSenseのスタックは100ミリ秒以下の待ち時間(レイテンシ)で入力を処理した。その際、センサーとプロセッサの消費電力は5mW未満だった。

SynSenseはいくつかのバージョンのプロセッサコアをテープアウトしている。また、Speckセンサーは、スマートフォンやスマートホーム用機器などリアルタイムの視覚検知用途で商業化する準備ができている。このカメラの128×128という解像度は、短距離の屋内用途には十分である(監視など屋外用途にはより高い解像度が必要になる)

【翻訳:青山麻由子、編集:EE Times Japan】

関連記事

米BrainChipがSNNプロセッサ向け開発キットを発表

米BrainChipがSNNプロセッサ向け開発キットを発表

ニューロモーフィックコンピューティングIP(Intellectual Property)のベンダーである米BrainChipは、2021年10月に米国カリフォルニア州サンタクララで開催され 「Linley Fall Processor Conference」で、同社のニューロモーフィックプロセッサSoC(System on Chip)「Akida」の開発キットを発表した。 Rain NeuromorphicsがアナログAIのデモチップをテープアウト

Rain NeuromorphicsがアナログAIのデモチップをテープアウト

Rain Neuromorphicsが、脳型アナログアーキテクチャのデモチップをテープアウトした。ランダムに接続されたメモリスタの3Dアレイを用い、ニューラルネットワークトレーニング/推論などを超低消費電力で計算することが可能だという。 積層型イベントベースビジョンセンサーを開発

積層型イベントベースビジョンセンサーを開発

ソニーとProphesee(プロフェシー)は、積層型イベントベースビジョンセンサーを共同開発した。画素サイズが4.86×4.86μmと極めて小さく、ダイナミックレンジは124dBを上回る。 脳型コンピュータはAIチップと競合するのか?

脳型コンピュータはAIチップと競合するのか?

新しいニューロモーフィックチップは、同様に最先端の分野であるAI(人工知能)アクセラレーターは、“競合”となるのか。ニューロモーフィックチップやAIアクセラレーターを開発する企業のCEOに、見解を聞いた。 リチウムイオン利用のスピントロニクス素子を開発

リチウムイオン利用のスピントロニクス素子を開発

東京理科大学と物質・材料研究機構(NIMS)の研究グループは、リチウムイオンを利用した低消費電力のスピントロニクス素子を開発した。磁気メモリ素子やニューロモルフィックデバイスなどへの応用が期待される。 Intel、1億ニューロンを組み込んだ脳型システムを発表

Intel、1億ニューロンを組み込んだ脳型システムを発表

Intelは2020年3月18日(米国時間)、約1億ニューロンの演算能力を備えた新しいニューロモーフィックコンピューティングシステム「Pohoiki(“ポホイキ”のように発音) Springs」を発表した。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- ソニー半導体、26年度は減収見込み メモリ市況不透明

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- 「画素の製造もパートナーと」十時氏が語る、ソニー×TSMC合弁の狙いと期待