1.2TB/s、24GBのHBM3 Gen2 LLMの学習を高速化:Micronがサンプル出荷を開始(1/2 ページ)

Micron Technologyは2023年7月、生成AI(人工知能)などの用途に向けて、1.2Tバイト/秒のメモリ帯域幅と、24Gバイトの容量を実現したHBM3 DRAM「HBM3 Gen2」のサンプリング出荷を開始したと発表した。

» 2023年07月28日 15時30分 公開

[村尾麻悠子,EE Times Japan]

Micron Technology(以下、Micron)は2023年7月26日(米国時間)、生成AI(人工知能)などの用途に向けてHBM3 DRAM「HBM3 Gen2」のサンプリング出荷を開始したと発表した。現在Micronで最先端のDRAMプロセスとなる1βノードを適用し、広島工場(広島県東広島市)で生産する。量産開始は、2024年第1四半期を予定している。

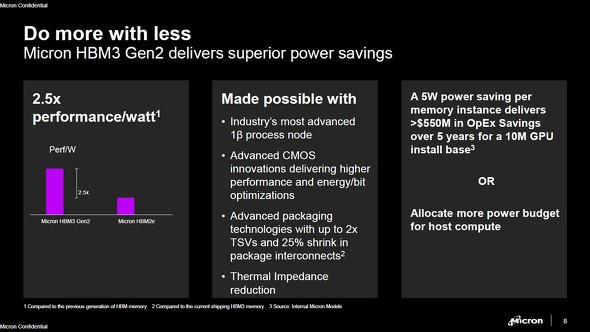

HBM3 Gen2は、1βノードを適用することで高速/大容量を実現した。メモリ帯域幅は1.2Tバイト/秒、ピン当たりの帯域幅で9.2Gビット/秒(bps)と、競合の既存のHBM3に比べて50%高速化したという。ダイ当たり24GビットのDRAMを8層(8個)積層し、11×11mmのパッケージで24Gバイトの容量を実現した。

パッケージでは、既存の競合品に比べてTSV(シリコン貫通ビア)の数を2倍にするとともに、D2D(ダイツーダイ)のインターコネクトを25%縮小。ノイズ耐性を強化し、SI(Signal Integrity)およびPI(Power Integrity)の向上にも注力したとする。これにより、電力当たりの性能は、Micronの前世代品に比べて2.5倍向上している。

Copyright © ITmedia, Inc. All Rights Reserved.

Special ContentsPR

特別協賛PR

スポンサーからのお知らせPR

Special ContentsPR

Pickup ContentsPR

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 村田製作所、25年度は売上高が過去最高 データセンター向けは70%増

Special SitePR

あなたにおすすめの記事PR