SK hynixがHBM3Eの量産を開始、NVIDIAのサプライヤー多様化で競争は激化:3月下旬から供給開始へ(2/2 ページ)

» 2024年03月21日 11時30分 公開

[永山準,EE Times Japan]

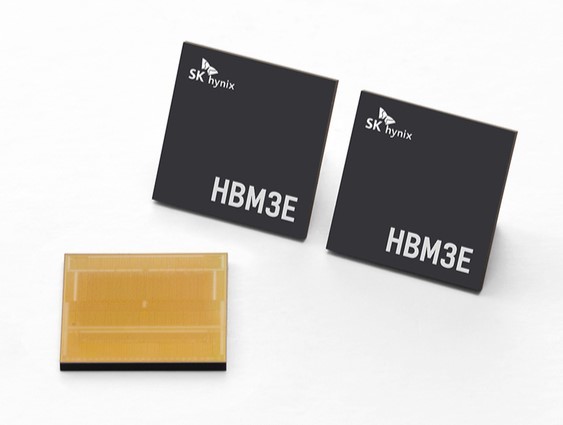

AIメモリに求められる全ての面で「業界最高」とSK

SK hynixは同社のHBM3Eについて「速度や放熱性能を含むAIメモリに求められる全ての面で業界最高」と説明。メモリ帯域幅は1.18TB/s(テラバイト/秒)を実現していて、「1秒間に230本以上のフルHD映画を処理するのに相当する」などと強調している。

放熱性能は前世代品から10%向上した。これは、チップ間の回路を保護するため、積層した半導体チップの間に液状の保護材を注入し、硬化させる工程である「2MR-MUF(Mass Reflow Molded Underfill)」と呼ばれるプロセスを適用したことで実現している。

SK hynixのHBM事業責任者であるSungsoo Ryu氏は、「HBM3Eの量産によって、業界をリードするAIメモリ製品ラインアップが完成した。HBM事業の成功体験と長年にわたって築いてきた顧客との強力なパートナーシップによって、当社はAIメモリの総合プロバイダーとしての地位を確固たるものにするだろう」と述べている。

関連記事

NVIDIAの「H200」GPUに載る Micronが24GB HBM3Eの量産を開始

NVIDIAの「H200」GPUに載る Micronが24GB HBM3Eの量産を開始

Micron Technologyが、8層積層の24GバイトHBM3E(広帯域幅メモリ3E)の量産を開始した。1βプロセスを適用する。2024年第2四半期に出荷を開始するNVIDIAの「H200 Tensorコア GPU」に搭載されるという。 Samsungが、「業界初」12層の36GB HBM3E DRAMを開発

Samsungが、「業界初」12層の36GB HBM3E DRAMを開発

Samsung Electronicsが、「業界初」(同社)となる12層の36Gバイト(GB)HBM3E DRAM製品「HBM3E 12H」を開発した。既にサンプル出荷を行っていて、2024年前半の量産開始を予定している。 2024年の半導体市場、本格回復はメモリ次第 〜HBMの需要増で勢力図も変わる?

2024年の半導体市場、本格回復はメモリ次第 〜HBMの需要増で勢力図も変わる?

半導体市場の本格的な回復が予想されている2024年。鍵を握るのがメモリだ。本稿では、DRAM/NAND型フラッシュメモリの価格推移と企業別売上高の動向から、半導体市場の回復基調の時期を探る。さらに、そこから読み取れる、メモリメーカーの“栄枯盛衰”を示す。 経産省、Micron広島工場に最大1920億円を助成

経産省、Micron広島工場に最大1920億円を助成

Micron Technologyの広島工場(広島県東広島市)は、経済産業省より最大1920億円の助成金を受け取ることに決まったと発表した。EUV(極端紫外線)露光を用いた1γ(ガンマ)DRAMの生産や、次世代広帯域メモリ(HBM4)の研究開発などに充てる。 NVIDIA、HBM3eメモリ採用の次世代GH200を発表

NVIDIA、HBM3eメモリ採用の次世代GH200を発表

NVIDIAは、生成AI用途に向けた次世代のコンピューティングプラットフォーム「NVIDIA GH200 Grace Hopper Superchip」を発表した。広帯域幅メモリの最新バージョンである「HBM3e」を採用した。現行製品に比べ、最大で3.5倍のメモリ容量と3倍の帯域幅を実現できるという。 1.2TB/s、24GBのHBM3 Gen2 LLMの学習を高速化

1.2TB/s、24GBのHBM3 Gen2 LLMの学習を高速化

Micron Technologyは2023年7月、生成AI(人工知能)などの用途に向けて、1.2Tバイト/秒のメモリ帯域幅と、24Gバイトの容量を実現したHBM3 DRAM「HBM3 Gen2」のサンプリング出荷を開始したと発表した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special ContentsPR

特別協賛PR

スポンサーからのお知らせPR

Special ContentsPR

Pickup ContentsPR

記事ランキング

- 「世界初」成果で1000層超3Dフラッシュに道筋、キオクシアとSandisk

- ナフサ危機で迫る「レジスト供給途絶」――世界の半導体工場を停止させる、もう一つの臨界点

- 次世代パワー半導体 「期待の5材料」の現在地

- パワー半導体世界市場、2035年は7兆円超え 酸化ガリウムも一定規模に

- 入学した瞬間終わったわ――「講義が英語」なんて一言も聞いてない!

- TSMCが次世代ロードマップ公表 A13/A12を29年投入へ

- SK hynixの四半期決算、驚異の売上高営業利益率70%超え

- 「データの死蔵に耐えられないエンジニア」がたどり着いたMASの沼

- TED、25年度は減収減益 「各事業磨き上げる」と新社長

- 村田製作所、25年度は売上高が過去最高 データセンター向けは70%増

Special SitePR

あなたにおすすめの記事PR